�γ���ҳ

�γ���Ƶ��PPT

�ϽڿΣ�������Ҫ�����˻���ѧϰ�Ķ��弰����Ҫ�ԣ���������ͼ����ʽ�����˻���ѧϰ���������̣�����ģ��H����Ӧһ����輯�ϣ���ͬ��ģ�Ͳ���ȡֵ��Ӧ��ͬ�ļ��裩��ʹ�����㷨A����ѵ������D�Ͻ���ѵ�����õ���õļ���h����Ӧһ����õIJ����������Ӧ�ĺ���g�������������Ҫ�Ļ���ѧϰ��ģ�ͺ�����һ��g�ӽ���Ŀ�꺯��f�����ڿν���������̽�ֻ���ѧϰ���⣬���ܸ�֪��Perceptronģ�ͣ����Ƶ��γ̵ĵ�һ������ѧϰ�㷨��Perceptron Learning Algorithm��PLA����

Ŀ¼

1. Perceptron Hypothesis Set

2. Perceptron Learning Algorithm(PLA)

3. Guarantee of PLA

4. Non-Separable Data

5. �ܽ�

1. Perceptron Hypothesis Set

��������һ�����ӣ�ij����Ҫ�����û������䡢�Ա��������������ж��Ƿ�����û������ÿ���������ѵ������D(x,y)����֮ǰ�û�����Ϣx���Ƿ������ÿ�y������һ�����͵Ļ���ѧϰ���⣬����Ҫ����D��ͨ��A����H��ѡ����õ�h���õ�g���ӽ�Ŀ�꺯��f��Ҳ���Ǹ�������֪ʶ�����Ƿ���û������ÿ���ģ�͡����������ģ�Ͷ��Ժ��û�x'�����жϣ������ÿ���+1�����Dz������ÿ���-1����

���������ѧϰ�����������У���һ�����ַdz���Ҫ������ģ��ѡ��Hypothesis Set��һ��ģ�Ͷ�Ӧһ�����輯����ͬ��ģ�Ͳ���ȡֵ��Ӧ��ͬ�ļ��裩��ѡ��ʲô����ģ�ͣ��ܴ�̶��ϻ�Ӱ�����ѧϰ��Ч���ͱ��֡��������һ�����õ�Hypothesis Set����֪����Perceptron����

���Ǹղ������Ƿ���û������ÿ������ӣ����ǰ��û��ĸ�����Ϣ��Ϊ��������x���ܹ���d�������������䡢�Ա�������ȣ���ÿ���������費ͬ��Ȩ��w����ʾ��������������Ƿ����ÿ�����Ӱ���ж�������������ļ�Ȩ�͵�ֵ��һ���趨����ֵthreshold���бȽϣ����������ֵ�����Ϊ+1���������ÿ���С�������ֵ�����Ϊ-1�����������ÿ�����֪��ģ�ͣ����ǵ�������Ȩ������ֵ�IJ����0�������h(x)=1����������Ȩ������ֵ�IJ�С��0�������h(x)=-1�������ǵ�Ŀ�ľ��Ǽ��������Ȩֵw����ֵthreshold��

����sign(x)�Ƿ��ź�������x>0ʱ��sign(x)=1;��x<0ʱ��sign(x)=-1;��x=0ʱ��sign(x)=0��������Ϊ0�������

Ϊ�˼��㷽�㣬ͨ�����ǽ���ֵthreshold����������

(��������x����һ��ֵΪ1�ķ���)������

��ˣ������Ͱ�thresholdҲת�����Ȩֵ

�����˼��㡣h(x)�ı���ʽ�����±任��

Ϊ�˸�������˵����֪��ģ�ͣ����Ǽ���Perceptrons�ڶ�άƽ����(��ʱ�����������������)����

������

��ƽ���ϵ�һ������ֱ��(���߽߱�),ֱ��һ�������ࣨ+1����ֱ����һ���Ǹ��ࣨ-1����Ȩ��w��ͬ����Ӧ��ƽ���ϲ�ͬ��ֱ�ߡ�

��ô��������˵��Perceptron�������ģ���Ͼ���һ��ֱ��(��������)����֮Ϊlinear(binary) classifiers��ע��һ�£���֪�����Է�����ڶ�ά�ռ��У���3D�У����Է�����ƽ���ʾ���ڸ���ά���У�������������ʱ�������Է����ó�ƽ���ʾ����ֻҪ������������ģ�;Ͷ�����linear(binary) classifiers��

ͬʱ����Ҫע����ǣ�������˵��linear(binary) classifiers���üĸ�֪��ģ�ͽ����ģ����Է����������ʹ��logistic regression����������潫����ܡ�

2. Perceptron Learning Algorithm(PLA)

������һ���ֵĽ��ܣ������Ѿ�֪����hypothesis set��������ֱ�߹���(����������һ�������Ӧһ��ֱ��)�������������ǵ�Ŀ�ľ���������һ�����㷨A����ѡ��һ����õ�ֱ�ߣ���õIJ��������ܽ�ƽ�������е����������ȫ�ֿ���Ҳ�����ҵ���õ�h�����dz���Ϊg��ʹg��f��

����ҵ�����һ����õ�ֱ���أ����ǿ���ʹ�����������˼�룬������ƽ��������ȡһ��ֱ�ߣ�������Щ��������Ȼ��ʼ�Ե�һ�������������������任ֱ�ߵ�λ�ã�ʹ���������ɷ�����ȷ�ĵ㡣���ţ��ٶԵڶ����������������еĴ����������ֱ�߾�����ֱ�����еĵ㶼��ȫ������ȷ�ˣ��͵õ�����õ�ֱ�ߡ����֡���������������PLA˼�����ڡ�

������Ȩ������

�·ִ���������t����������������ÿһ���ҵ�D�е�һ���ִ���������

�������һ��PLA����ô���ġ��������ѡ��һ��ֱ�߽��з���(�����ʼ��w�����߽����ʼ��Ϊ0)��Ȼ���ҵ���һ���������ĵ㣬���������ʾ���࣬�����Ϊ���࣬��,˵������w��x�н�>90�ȣ�����w��ֱ�ߵķ����������ԣ�x�������ֱ�ߵ��²ࣨ����ڷ��������������ķ���Ϊ�������ڵ�һ�ࣩ�������ķ�������ʹw��x�н�С��90�ȡ�ͨ����������

,y=1.���������Ͻǵ�ͼ��ʾ��һ�λ��θ��º��

��x�ļнǻ�С��90�ȣ��ܱ�֤x��ֱ�ߵ��Ϸ�(�������ķ�������)��������Ϊ����Ĵ���������ֱ��������

ͬ������������Ϊ����ĵ㣬��,˵������w��x�н�<90�ȣ�����w��ֱ�ߵķ����������ԣ�x�������ֱ�ߵ��ϲ࣬�����ķ�������ʹw��x�нǴ���90�ȡ�ͨ����������

,y=-1.���������½ǵ�ͼ��ʾ��һ�λ��θ��º��

��x�ļнǻ�С��90�ȣ��ܱ�֤x��ֱ�ߵ��·�(�������ķ�������)��������Ϊ����Ĵ���������ֱ��������

��������˼�룬�����������ͽ������������ϵ�����Ҫע��һ�㣺ÿ������ֱ�ߣ�����ʹ֮ǰ������ȷ�ĵ��ɴ���㣬���ǿ��ܷ����ġ�����û��ϵ�����ϵ������������������ջὫ���е���ȫ��ȷ���ࣨPLAǰ�������Կɷֵģ�������������˼���ǡ�֪���ܸġ����о仰����������A fault confessed is half redressed.��

ʵ�ʲ����У�����һ����һ����ر��������ַ������ĵ�ͽ���������ֱ�����е�ȫ��������ȷ�����ֱ���ΪCyclic PLA��

������ͼ�����ʽ������PLA���������̣�

��PLA��������Ҫ���������������⣺

- PLA����һ����ͣ������������Բ��ɷ���ô�죿

- PLAͣ������ʱ���ܷ�֤

? ���û��ͣ�������Ƿ���

��

3. Guarantee of PLA

PLAʲôʱ���ͣ�����أ�����PLA�Ķ��壬���ҵ�һ��ֱ�ߣ��ܽ�����ƽ���ϵĵ㶼������ȷ����ôPLA��ֹͣ�ˡ�Ҫ�ﵽ�����ֹ�������ͱ��뱣֤D�����Կɷ֣�linear separable��������Ƿ����Կɷֵģ���ô��PLA�Ͳ���ֹͣ��

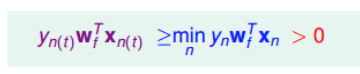

�������Կɷֵ���������������һ��ֱ�ߣ��ܹ������������ȫ�ֿ�������ʱ���Ŀ��Ȩ��Ϊ,��ô����ÿ���㣬��Ȼ����

,������һ�㣺

PLA���ÿ�δ���ĵ��������������Ȩ����ֵ�����

��

Խ��Խ�ӽ�����ѧ�����Ͼ����ڻ�Խ���DZ�ʾ

���ڽӽ�Ŀ��Ȩ��

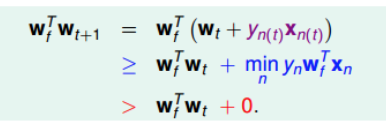

��֤��PLA����ѧϰЧ���ġ����ԣ�����������

��

���ڻ���

���Ƶ����Կ�������

���ڻ���

��

���ڻ������ˡ��ƺ�˵����

���ӽ�

�������ڻ����������������ȸ����ˣ���һ����������Ƕȸ�С�����ԣ���һ�������ǻ���Ҫ֤��

��

�������ȵĹ�ϵ��

ֻ���ڷ�����������¸��£����յõ���

���

������ֵ������

��Ҳ����˵��

�������������ˣ�

��

�������Ȳ�����̫��

������ʼȨֵ����ô����T�δ��������������½��ۣ�

�ý��۵ľ����Ƶ��������£�

��������ʽ�����ʵ����

�нǵ�����ֵ�����ŵ�������T����������ֵԽ��Խ��Խ��Խ�ӽ�1����

��

Խ��Խ�ӽ���ͬʱ��ע��

,Ҳ����˵����������T�����Ͻ�ġ���������֤�����������յõ��Ľ�����:

��

�����ŵ����������ӣ��ӽ��ġ����ң�PLA���ջ�ͣ��������ΪT���Ͻ磩��ʵ�ֶ����Կɷֵ����ݼ���ȫ���ࡣ

4. Non-Separable Data

��һ���֣�����֤�������Կɷֵ�����£�PLA�ǿ���ͣ��������ȷ����ģ������ڷ����Կɷֵ������ʵ���ϲ������ڣ���ô֮ǰ���Ƶ�����������PLA��һ����ͣ���������ԣ�PLA��Ȼʵ�ּ���Ҳ��ȱ�㣺

���ڷ����Կɷֵ���������ǿ��������������ݼ�D�в�����һ��noise����ʵ�ϣ���������������������D���������ٵز�����noise����ʱ������ѧϰ�����������ģ�

�ڷ���������£����ǿ����������ɣ���������ÿ���㶼������ȷ�����������д���㣬ȡ�����ĸ�������ʱ��Ȩ��w��

��ʵ֤��������Ľ���NP-hard���⣬������⡣Ȼ�������ǿ��Զ������Կɷ������б��ֺܺõ�PLA�����ģ�����Ӧ�õ������Կɷ������У���ý�����õ�g��

��ʼ��һ���ڴ�Ȩ������(),��PLA��࣬ÿ�������ѵ����D�е�ѡ��һ���ִ�����������

��Ȼ���Ȩ������

��������/���µõ�

����ͬ���ǣ����������Ȩ������

��

���бȽϣ�������һ��ѵ������������Ȩ������

�����ϣ��ܹ��ִ��˶����������������

�ܹ��ִ��˶������������

��

������٣�����������Ȩ������

����

��

��Ҫ����һ��������������ʵ֤�������㹻��ĵ����������Ϳ��Եõ�һ��������Ȩ������(��Ӧ���躯��g�����������Ƚ��١�

����ж����ݼ�D�Dz������Կɷ֣����ڶ�ά������˵��ͨ������ͨ�����۹۲����жϵġ�һ������£�Pocket AlgorithmҪ��PLA�ٶ���һЩ��

5. �ܽ�

���ڿ���Ҫ���������Ը�֪��ģ�ͣ��Լ���������֪����������ļ��㷨��PLA��������ϸ֤���˶������Կɷ����⣬PLA����ͣ������ʵ����ȫ��ȷ���ࡣ���ڲ������Կɷֵ����⣬����ʹ��PLA�������㷨Pocket Algorithm�������