教程地址:http://www.deeplearning.net/tutorial/SdA.html

The Stacked Denoising Autoencoder (SdA) is an extension of the stacked autoencoder[Bengio07]and it was introduced in [Vincent08].

推荐先看这个UFLDL,讲得很详细:http://deeplearning.stanford.edu/wiki/index.php/%E6%A0%88%E5%BC%8F%E8%87%AA%E7%BC%96%E7%A0%81%E7%AE%97%E6%B3%95

我之前一个做的UFLDL中栈式自编码的作业(但是不是降噪自编码,是稀疏自编码):UFLDL教程答案(6):Exercise:Implement deep networks for digit classification

Stacked Autoencoders

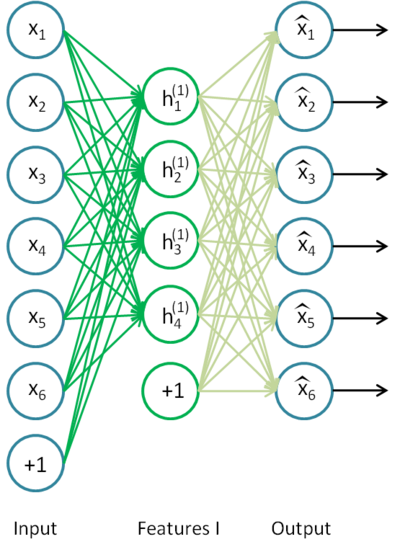

回顾下自编码:(目标是输出层(重构层)尽量重构输入,即与输入尽量一致,那么隐藏层就相当于抓住了数据的内在特征)

降噪自编码器可以一层一层堆叠成栈式自编码器,(重构层去掉),前一层的隐层输出(latent representation (output code))为后一自编码层的输入下图是UFLDL中两层自编码层堆叠的图例:

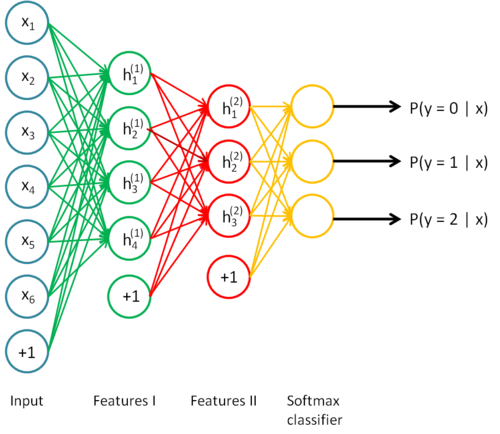

逐层贪婪训练:每层自编码层都单独进行非监督训练,以最小化输入(输入为前一层的隐层输出)与重构结果之间的误差为训练目标。前K层训练好了,就可以训练K+1层,因为已经前向传播求出K层的输出,再用K层的输出当作K+1的输入训练K+1层。

在所有自编码层都完成预训练之后,在对网络进行微调,即用样本进行有监督训练,在网络最后一层加上一层logistic regression layer(softmax层),像Multilayer Perceptron那样训练。

构建class SdA

下面这段是如何利用之前实现的LR,MLP,DA等构建SDA

We can see the stacked denoising autoencoder(sda) as having two facades: a list of autoencoders, and an MLP.

在预训练时,sda可以看作很多个自编码器相连,逐个无监督训练;

在微调时,sda可以看作一个多层感知器进行有监督训练。

- sigmoid_layer = HiddenLayer(rng=numpy_rng,

- input=layer_input,

- n_in=input_size,

- n_out=hidden_layers_sizes[i],

- activation=T.nnet.sigmoid)

- dA_layer = dA(numpy_rng=numpy_rng,

- theano_rng=theano_rng,

- input=layer_input,

- n_visible=input_size,

- n_hidden=hidden_layers_sizes[i],

- W=sigmoid_layer.W,

- bhid=sigmoid_layer.b)

代码中可以看出:自编码层和多层感知器的隐层其实是共用的权重,其实每层既是dA,又是HiddenLayer,这样就可以使用之前的mlp.py,dA.py来实现sda。

- class SdA(object):

- """Stacked denoising auto-encoder class (SdA)

- A stacked denoising autoencoder model is obtained by stacking several

- dAs. The hidden layer of the dA at layer `i` becomes the input of

- the dA at layer `i+1`. The first layer dA gets as input the input of

- the SdA, and the hidden layer of the last dA represents the output.

- Note that after pretraining, the SdA is dealt with as a normal MLP,

- the dAs are only used to initialize the weights.

- """

- def __init__(

- self,

- numpy_rng,

- theano_rng=None,

- n_ins=784,

- hidden_layers_sizes=[500, 500],

- n_outs=10,

- corruption_levels=[0.1, 0.1]

- ):

- """ This class is made to support a variable number of layers.

- :type numpy_rng: numpy.random.RandomState

- :param numpy_rng: numpy random number generator used to draw initial

- weights

- :type theano_rng: theano.tensor.shared_randomstreams.RandomStreams

- :param theano_rng: Theano random generator; if None is given one is

- generated based on a seed drawn from `rng`

- :type n_ins: int

- :param n_ins: dimension of the input to the sdA

- :type n_layers_sizes: list of ints

- :param n_layers_sizes: intermediate layers size, must contain

- at least one value

- :type n_outs: int

- :param n_outs: dimension of the output of the network

- :type corruption_levels: list of float

- :param corruption_levels: amount of corruption to use for each

- layer

- """

- self.sigmoid_layers = []

- self.dA_layers = []

- self.params = []

- self.n_layers = len(hidden_layers_sizes)

- assert self.n_layers > 0

- if not theano_rng:

- theano_rng = RandomStreams(numpy_rng.randint(2 ** 30))

- # allocate symbolic variables for the data

- self.x = T.matrix('x') # the data is presented as rasterized images

- self.y = T.ivector('y') # the labels are presented as 1D vector of

- # [int] labels

Next, we construct n_layers sigmoid layers and n_layers denoising autoencoders, where n_layers is the depth of our model.

注意:MLP隐层稍微有点修改激活函数把tanh函数改成了sigmoid函数:

- # start-snippet-2

- for i in xrange(self.n_layers):

- # construct the sigmoidal layer

- # the size of the input is either the number of hidden units of

- # the layer below or the input size if we are on the first layer

- if i == 0:

- input_size = n_ins

- else:

- input_size = hidden_layers_sizes[i - 1]

- # the input to this layer is either the activation of the hidden

- # layer below or the input of the SdA if you are on the first

- # layer

- if i == 0:

- layer_input = self.x

- else:

- layer_input = self.sigmoid_layers[-1].output

- sigmoid_layer = HiddenLayer(rng=numpy_rng,

- input=layer_input,

- n_in=input_size,

- n_out=hidden_layers_sizes[i],

- activation=T.nnet.sigmoid)

- # add the layer to our list of layers

- self.sigmoid_layers.append(sigmoid_layer)

- # its arguably a philosophical question...

- # but we are going to only declare that the parameters of the

- # sigmoid_layers are parameters of the StackedDAA

- # the visible biases in the dA are parameters of those

- # dA, but not the SdA

- self.params.extend(sigmoid_layer.params)

- # Construct a denoising autoencoder that shared weights with this

- # layer

- dA_layer = dA(numpy_rng=numpy_rng,

- theano_rng=theano_rng,

- input=layer_input,

- n_visible=input_size,

- n_hidden=hidden_layers_sizes[i],

- W=sigmoid_layer.W,

- bhid=sigmoid_layer.b)

- self.dA_layers.append(dA_layer)

- # end-snippet-2

- # We now need to add a logistic layer on top of the MLP

- self.logLayer = LogisticRegression(

- input=self.sigmoid_layers[-1].output,

- n_in=hidden_layers_sizes[-1],

- n_out=n_outs

- )

- self.params.extend(self.logLayer.params)

- # construct a function that implements one step of finetunining

- # compute the cost for second phase of training,

- # defined as the negative log likelihood

- self.finetune_cost = self.logLayer.negative_log_likelihood(self.y)

- # compute the gradients with respect to the model parameters

- # symbolic variable that points to the number of errors made on the

- # minibatch given by self.x and self.y

- self.errors = self.logLayer.errors(self.y)

再加一个softmax层(2类问题时就是logistic layer)

- # We now need to add a logistic layer on top of the MLP

- self.logLayer = LogisticRegression(

- input=self.sigmoid_layers[-1].output,

- n_in=hidden_layers_sizes[-1],

- n_out=n_outs

- )

- self.params.extend(self.logLayer.params)

- # construct a function that implements one step of finetunining

- # compute the cost for second phase of training,

- # defined as the negative log likelihood

- self.finetune_cost = self.logLayer.negative_log_likelihood(self.y)

- # compute the gradients with respect to the model parameters

- # symbolic variable that points to the number of errors made on the

- # minibatch given by self.x and self.y

- self.errors = self.logLayer.errors(self.y)

构建Theano function:各层的预训练函数

下面这个函数是为每 i 层生成一个Theano function类型的预训练函数,返回值是一个list,list中就是每层的预训练函数

为了能在训练中更改 the corruption level or the learning rate ,我们定义Theano variables。

- def pretraining_functions(self, train_set_x, batch_size):

- ''''' Generates a list of functions, each of them implementing one

- step in trainnig the dA corresponding to the layer with same index.

- The function will require as input the minibatch index, and to train

- a dA you just need to iterate, calling the corresponding function on

- all minibatch indexes.

- :type train_set_x: theano.tensor.TensorType

- :param train_set_x: Shared variable that contains all datapoints used

- for training the dA

- :type batch_size: int

- :param batch_size: size of a [mini]batch

- :type learning_rate: float

- :param learning_rate: learning rate used during training for any of

- the dA layers

- '''

- # index to a [mini]batch

- index = T.lscalar('index') # index to a minibatch

- corruption_level = T.scalar('corruption') # % of corruption to use

- learning_rate = T.scalar('lr') # learning rate to use

- # begining of a batch, given `index`

- batch_begin = index * batch_size

- # ending of a batch given `index`

- batch_end = batch_begin + batch_size

- pretrain_fns = []

- for dA in self.dA_layers:

- # get the cost and the updates list

- cost, updates = dA.get_cost_updates(corruption_level,

- learning_rate)

- # compile the theano function

- fn = theano.function(

- inputs=[

- index,

- theano.Param(corruption_level, default=0.2),

- theano.Param(learning_rate, default=0.1)

- ],

- outputs=cost,

- updates=updates,

- givens={

- self.x: train_set_x[batch_begin: batch_end]

- }

- )

- # append `fn` to the list of functions

- pretrain_fns.append(fn)

- return pretrain_fns

每层的训预练函数为 pretrain_fns[i] ,输入为 index (minibatch的序号,即这次训练用第index个minibatch),此外还有两个Theano 变量可以修改:corruption—the corruption level or lr—the learning rate.

构建Theano function:微调部分所需函数

3个函数:train_fn,valid_score,test_score。其中valid_score,test_score是python 函数,不是Theano function,是用来训练过程中计算损失的。

- def build_finetune_functions(self, datasets, batch_size, learning_rate):

- '''''Generates a function `train` that implements one step of

- finetuning, a function `validate` that computes the error on

- a batch from the validation set, and a function `test` that

- computes the error on a batch from the testing set

- :type datasets: list of pairs of theano.tensor.TensorType

- :param datasets: It is a list that contain all the datasets;

- the has to contain three pairs, `train`,

- `valid`, `test` in this order, where each pair

- is formed of two Theano variables, one for the

- datapoints, the other for the labels

- :type batch_size: int

- :param batch_size: size of a minibatch

- :type learning_rate: float

- :param learning_rate: learning rate used during finetune stage

- '''

- (train_set_x, train_set_y) = datasets[0]

- (valid_set_x, valid_set_y) = datasets[1]

- (test_set_x, test_set_y) = datasets[2]

- # compute number of minibatches for training, validation and testing

- n_valid_batches = valid_set_x.get_value(borrow=True).shape[0]

- n_valid_batches /= batch_size

- n_test_batches = test_set_x.get_value(borrow=True).shape[0]

- n_test_batches /= batch_size

- index = T.lscalar('index') # index to a [mini]batch

- # compute the gradients with respect to the model parameters

- gparams = T.grad(self.finetune_cost, self.params)

- # compute list of fine-tuning updates

- updates = [

- (param, param - gparam * learning_rate)

- for param, gparam in zip(self.params, gparams)

- ]

- train_fn = theano.function(

- inputs=[index],

- outputs=self.finetune_cost,

- updates=updates,

- givens={

- self.x: train_set_x[

- index * batch_size: (index + 1) * batch_size

- ],

- self.y: train_set_y[

- index * batch_size: (index + 1) * batch_size

- ]

- },

- name='train'

- )

- test_score_i = theano.function(

- [index],

- self.errors,

- givens={

- self.x: test_set_x[

- index * batch_size: (index + 1) * batch_size

- ],

- self.y: test_set_y[

- index * batch_size: (index + 1) * batch_size

- ]

- },

- name='test'

- )

- valid_score_i = theano.function(

- [index],

- self.errors,

- givens={

- self.x: valid_set_x[

- index * batch_size: (index + 1) * batch_size

- ],

- self.y: valid_set_y[

- index * batch_size: (index + 1) * batch_size

- ]

- },

- name='valid'

- )

- # Create a function that scans the entire validation set

- def valid_score():

- return [valid_score_i(i) for i in xrange(n_valid_batches)]

- # Create a function that scans the entire test set

- def test_score():

- return [test_score_i(i) for i in xrange(n_test_batches)]

- return train_fn, valid_score, test_score

Putting it all together

使用 class SdA 构造:

- numpy_rng = numpy.random.RandomState(89677)

- print '... building the model'

- # construct the stacked denoising autoencoder class

- sda = SdA(

- numpy_rng=numpy_rng,

- n_ins=28 * 28,

- hidden_layers_sizes=[1000, 1000, 1000],

- n_outs=10

- )

训练分为两部分:逐层预训练(自编码);微调(与MLP训练一样)。

第一部分:我们对所有层逐层训练,对每层,我们用 the compiled Theano function (pretrain_fns[ i ])利用随机梯度下降(SGD),以最小化重构误差为优化目标,

训练优化当前层权重。根据 pretraining_epochs 决定训练集迭代多少次。

- #########################

- # PRETRAINING THE MODEL #

- #########################

- print '... getting the pretraining functions'

- pretraining_fns = sda.pretraining_functions(train_set_x=train_set_x,

- batch_size=batch_size)

- print '... pre-training the model'

- start_time = timeit.default_timer()

- ## Pre-train layer-wise

- corruption_levels = [.1, .2, .3]

- for i in xrange(sda.n_layers):

- # go through pretraining epochs

- for epoch in xrange(pretraining_epochs):

- # go through the training set

- c = []

- for batch_index in xrange(n_train_batches):

- c.append(pretraining_fns[i](index=batch_index,

- corruption=corruption_levels[i],

- lr=pretrain_lr))

- print 'Pre-training layer %i, epoch %d, cost ' % (i, epoch),

- print numpy.mean(c)

- end_time = timeit.default_timer()

- print >> sys.stderr, ('The pretraining code for file ' +

- os.path.split(__file__)[1] +

- ' ran for %.2fm' % ((end_time - start_time) / 60.))

第二部分:微调和 Multilayer Perceptron 中的训练基本一样,唯一不同是这里使用了 build_finetune_functions,更加简洁方便。

Running the Code

By default the code runs 15 pre-training epochs for each layer, with a batch size of 1. The corruption levels are 0.1 for the first layer, 0.2 for the second, and 0.3 for the third. The pretraining learning rate is 0.001 and the finetuning learning rate is 0.1. Pre-training takes 585.01 minutes, with an average of 13 minutes per epoch. Fine-tuning is completed after 36 epochs in 444.2 minutes, with an average of 12.34 minutes per epoch. The final validation score is 1.39% with a testing score of 1.3%.

与UFLDL教程答案(6):Exercise:Implement deep networks for digit classification 结果对比:UFLDL中为2.26%,这里为1.3%,这里比UFLDL效果好一些。

结果不同的可能原因:

1.这里是降噪自编码,UFLDL中是稀疏自编码。

2.这里是3个隐藏层(自编码层),UFLDL中只有2个。

3.但是需要注意的是,UFLDL中把mnist数据中的train set 和 validation set 都合成了一个train set ,样本量有60000个,比这里多了一个validation set的数量。

Tips and Tricks

这个 trick 主要应用于预训练,预训练一层完成后,把数据通过这层,前向传播算得这层的输出,然后把输出记录下来(你得有足够内存)。再预训练后面一层,训练好后,又用刚才记录的数据输入这层,得到前向传播输出,再记录下来。。。。

这样把所有层都预训练一遍,如果为n层,只需要计算n此前向传播,不用每层都得把数据从第一层前向传播过来。