用于Few-Shot语义分割的条件网络(ICLR2018 WorkShop)

本文作为一个WorkShop,主要是阐述了小样本分割对于稀疏标签的鲁棒性,说明使用稀疏标签来指导小样本分割也是可行的。

论文地址

摘要

该网络通过对一个标注的图像支持集进行特征融合来对一个未标注的查询图像进行推理。一旦学会了,我们的条件方法就不需要进一步优化新的数据。注释在一次向前传递中是有条件的,使我们的方法适合交互式使用。我们通过密集和稀疏标注来评估我们的co-FCN,即使只给出一个正像素和一个负像素,也能达到具有竞争力的精度,减少了新类分割的标注负担。

存在的问题

目前的一些方法依赖于元学习,或学习如何学习(learning to learn),以快速适应新的领域或任务。虽然这些方法很有希望,但重点一直放在分类上,而对结构化输出任务所做的工作很少。由于输出空间的高维性,以及由输入像素的空间相关性导致的输出之间的统计相关性,目前的方法在很大程度上不能开箱即用地应用于结构化输出设置

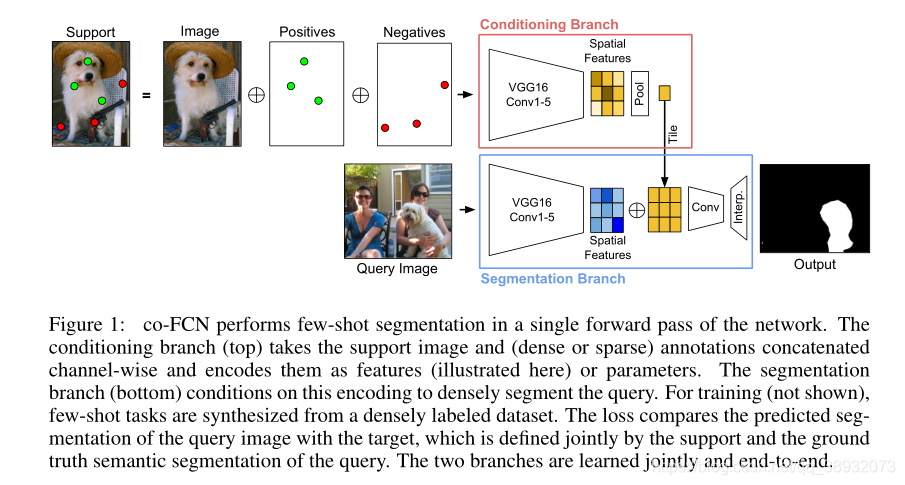

在我们的co-FCN网络中,我们增加了FCN架构,并添加了一个条件分支,以整合Few-Shot的注释。测试时无梯度流动;即给出一个新的Few-Shot任务,求解它是网络中的一次向前计算而无反向传播过程。在训练过程中,我们通过从密集标记的语义分割数据集中采样来模拟Few-Shot任务。

方法

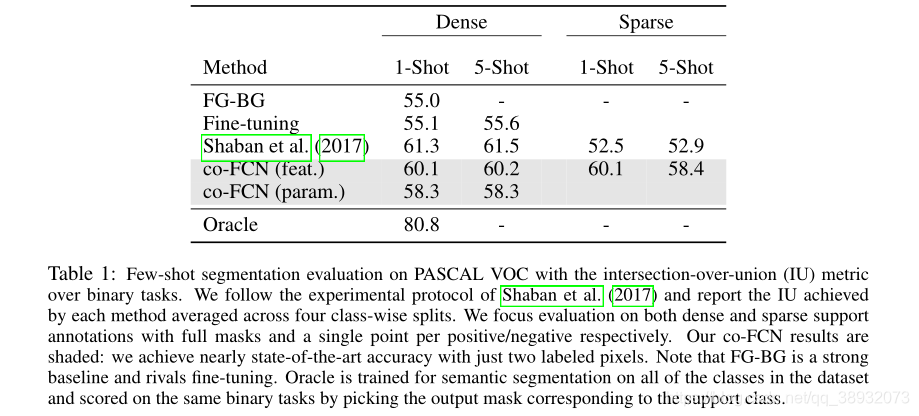

Few-Shot分割的目的是学习分割新的类,只给出了这些类的几个带注释的例子。k-shot任务由k个图像标注对的标注支持集和未标注查询组成。分割任务为经典的Few-Shot设置添加了一个新的维度,因为支持集注释可能是空间密集的,也可能是稀疏的。我们对这两种方法都进行了研究,并表明co-FCN对稀疏注释的鲁棒性比其他方法更强。

在实践中,FCNs提供精确和连贯的像素预测,但它们需要太多的参数进行微调,无法作为一种Few-Shot的学习方法来获得成功。相反,我们将Few-Shot训练和测试范式结合起来,以产生一个在测试时不需要优化的模型。

co-FCN的原理图如图1所示。分割分支,给定条件特征或参数,是一个标准的FCN,用于对查询进行分割。条件分支将支持集作为输入,并做出一个全局池化预测以指导查询图像的分割。这个预测可能是特征,然后将这些特征与查询特征融合,以便进一步处理。或者,条件分支可以在查询分支的末尾预测线性分类层的参数(也就是类似OSLSM的方法)。我们在实验中探索了这两种选择的性能。

在我们的实验中,我们使用了一个稀疏注释的支持集。在查询的预测和它的二值化标签之间计算交叉熵损失。该网络直接针对Few-Shot任务进行优化;对条件分支和分割分支进行端到端的联合优化。

实验结果

总结

在学习如何从稀疏标注指导快速准确的Few-Shot分割方面,全卷积条件网络是最先进的。除了比微调更精确之外,我们的条件模型也更快,因为它在测试时不需要优化。处理稀疏注释的能力使co-FCN特别适合交互式使用,例如传播标签来分割个人照片集。我们的方法也可以用于自动注释未标记的数据。需要进一步的实验来评估模型转移到不可见数据集的能力。