����Ŀ¼

- һ��Flume����

-

- 1.1 Flume����

- 1.2 Flume���ŵ�

- 1.3 Flume��ɼܹ�

- 1.4 Flume���˽ṹ

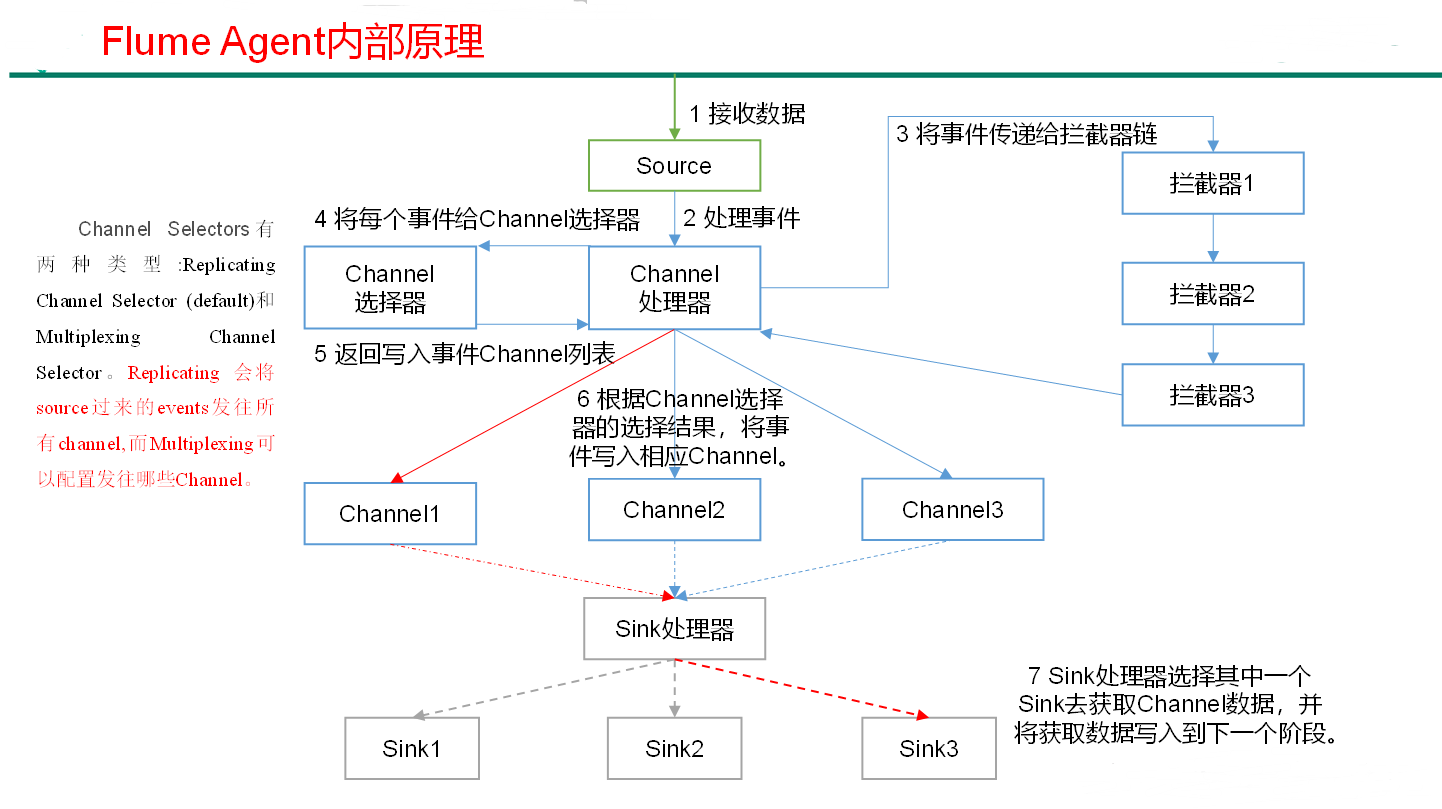

- 1.5 Flume Agent�ڲ�ԭ��

- 1.6 Flume��װ

- ������ҵ��������

-

- 2.1 ��ض˿�����

- 2.2 ʵʱ��ȡ�����ļ���HDFS

- 2.3 ʵʱ��ȡĿ¼�ļ���HDFS

- 2.4 ������Դ����ڰ���(ѡ����)

- 2.5 ������Դ����ڰ���(Sink��)

- 2.6 ������Դ���ܰ���

һ��Flume����

1.1 Flume����

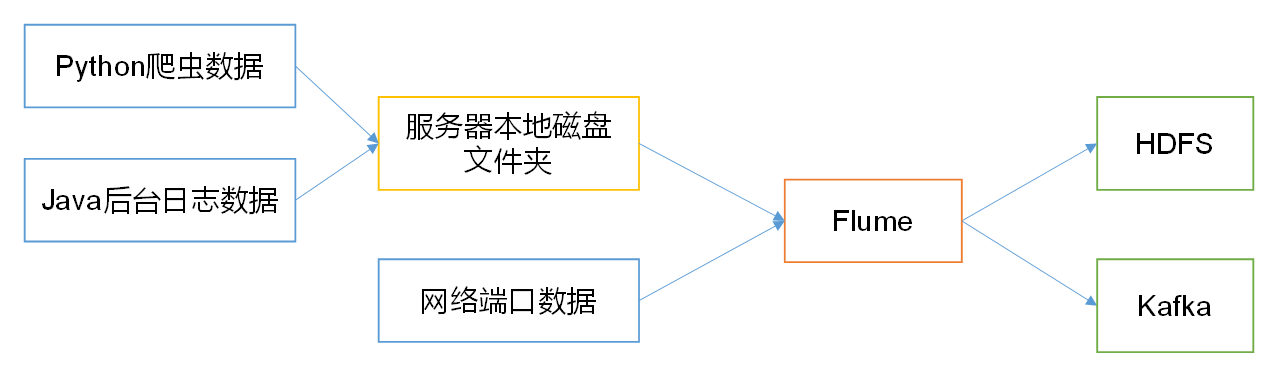

Flume��Cloudera�ṩ��һ���߿��õģ��߿ɿ��ģ��ֲ�ʽ�ĺ�����־�ɼ����ۺϺʹ����ϵͳ��Flume������ʽ�ܹ�������

Flume����Ҫ�����þ��ǣ�ʵʱ��ȡ���������ش��̵����ݣ�������д�뵽HDFS��

1.2 Flume���ŵ�

- ���Ժ�����洢���̼���

- ����ĵ��������ʴ���д��Ŀ�Ĵ洢�����ʣ�

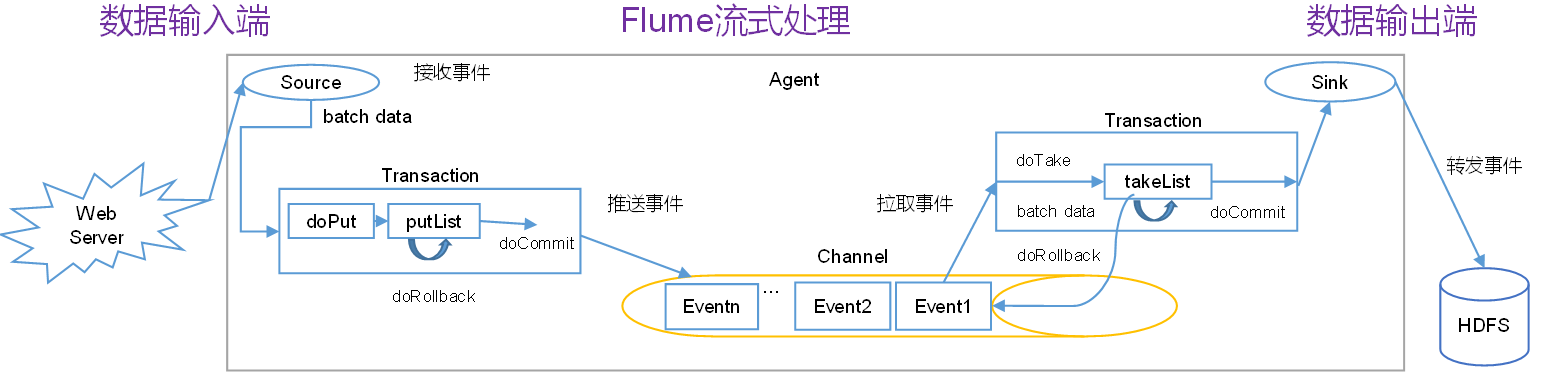

Flume����л��壬��СHDFS��ѹ���� Flume�е��������Channel��ʹ������������ģ�ͣ�sender+receiver����ȷ����Ϣ���ɿ����͡�

Flumeʹ����������������ֱ����soucrce��channel���Լ���channel��sink���¼����ݡ�һ�����������е�����ȫ���ɹ��ύ��channel����ôsource����Ϊ�����ݶ�ȡ��ɡ�ͬ����ֻ�гɹ���sinkд��ȥ�����ݣ��Ż��channel���Ƴ���

1.3 Flume��ɼܹ�

Put����������

doPut������������д����ʱ������putListdoCommit�����channel�ڴ�����Ƿ��㹻�ϲ���doRollback��channel�ڴ���пռ䲻�㣬�ع�����

Take������

doTake���Ƚ�����ȡ����ʱ������takeListdoCommit���������ȫ�����ͳɹ����������ʱ������takeListdoRollback�����ݷ���������������쳣��rollback����ʱ������takeList�е����ݹ黹��channel�ڴ���С�

������������ϸ����һ��Flume�ܹ��е������

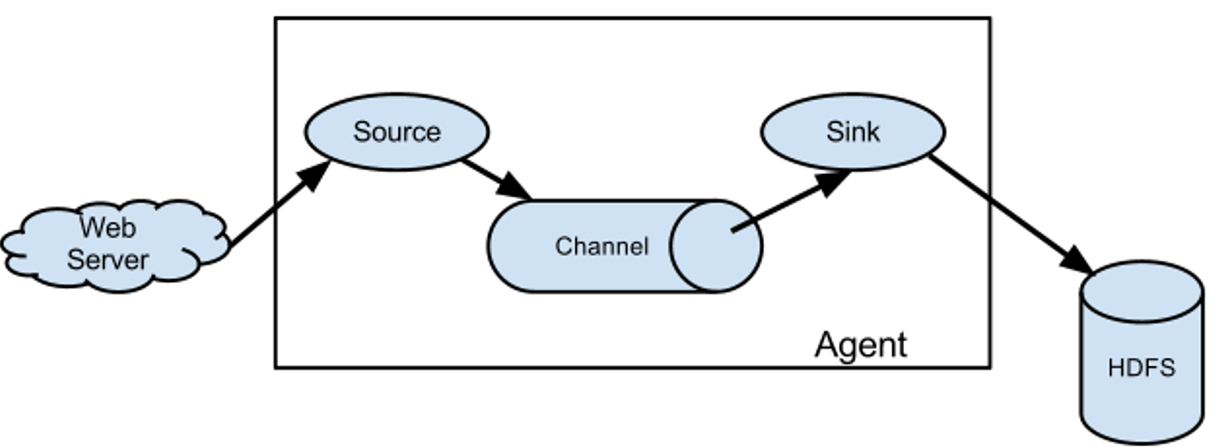

��Agent

Agent��һ��JVM���̣������¼�����ʽ�����ݴ�Դͷ����Ŀ�ġ�

Agent��Ҫ��3��������ɣ�Source��Channel��Sink��

��Source

Source�Ǹ���������ݵ�Flume Agent�������Source������Դ����������͡����ָ�ʽ����־���ݣ�����avro��thrift��exec��jms��spooling directory��netcat��sequence generator��syslog��http��legacy��

��Channel

Channel��λ��Source��Sink֮��Ļ���������ˣ�Channel����Source��Sink�����ڲ�ͬ�������ϡ�Channel���̰߳�ȫ�ģ�����ͬʱ��������Source��д������ͼ���Sink�Ķ�ȡ������

Flume�Դ�����Channel��Memory Channel��File Channel��

Memory Channel���ڴ��еĶ��С�Memory Channel�ڲ���Ҫ�������ݶ�ʧ���龰�����á������Ҫ�������ݶ�ʧ����ôMemory Channel�Ͳ�Ӧ��ʹ�ã���Ϊ��������������崻������������ᵼ�����ݶ�ʧ��

File Channel���������¼�д�����̡�����ڳ���رջ����崻�������²��ᶪʧ���ݡ�

��Sink

Sink���ϵ���ѯChannel�е��¼����������Ƴ����ǣ�������Щ�¼�����д�뵽�洢������ϵͳ�����߱����͵���һ��Flume Agent��

Sink����ȫ�����Եġ��ڴ�Channel����ɾ������֮ǰ��ÿ��Sink��Channel����һ�����������¼�һ���ɹ�д�����洢ϵͳ����һ��Flume Agent��Sink������Channel�ύ��������һ�����ύ����Channel���Լ����ڲ�������ɾ���¼���

Sink���Ŀ�ĵذ���hdfs��logger��avro��thrift��ipc��file��null��HBase��solr���Զ���

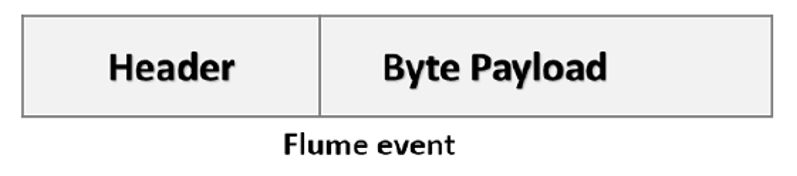

��Event

Flume���ݴ���Ļ�����Ԫ�����¼�����ʽ�����ݴ�Դͷ����Ŀ�ĵء�Event�ɿ�ѡ��header���������ݵ�һ��byte array���ɡ�Header��������key-value�ַ����Ե�HashMap��

1.4 Flume���˽ṹ

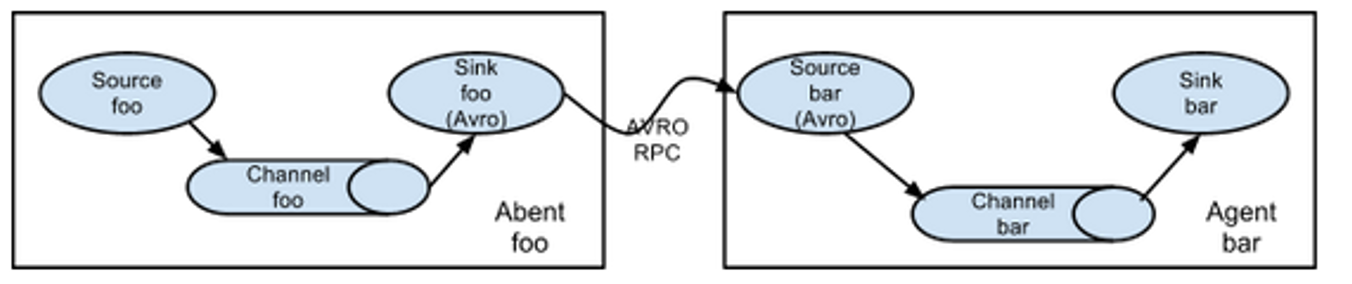

��Flume Agent����

����ģʽ�ǽ����Flume��˳�����������ˣ��������Source��ʼ������Sink���͵�Ŀ�Ĵ洢ϵͳ����ģʽ�������Žӹ����Flume������Flume�����������Ӱ�촫�����ʣ�����һ�����������ij���ڵ�Flume崻�����Ӱ����������ϵͳ��

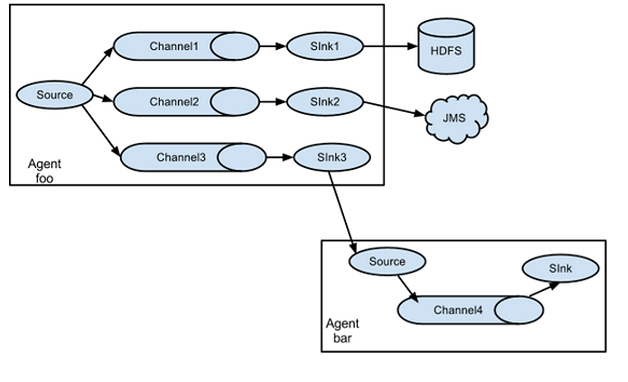

�ڵ�source����channel��sink

Flume֧�ֽ��¼�����һ�����߶��Ŀ�ĵء�����ģʽ������Դ���Ƶ����Channel�У�ÿ��Channel������ͬ�����ݣ�Sink����ѡ���͵IJ�ͬ��Ŀ�ĵء�

��Flume���ؾ���

Flume֧��ʹ�ý����Sink���Ϸֵ�һ��Sink�飬Flume�����ݷ��͵���ͬ��Sink����Ҫ������ؾ������ת�����⡣

�� Flume Agent�ۺ�

����ģʽ����������ģ�Ҳ�dz�ʵ�ã��ճ�webӦ��ͨ���ֲ����ϰٸ�������������������ǧ�������������������������־����������Ҳ�dz��鷳����Flume��������Ϸ�ʽ�ܺܺõĽ����һ���⣬ÿ̨����������һ��Flume�ɼ���־�����͵�һ�������ռ���־��Flume�����ɴ�Flume�ϴ���hdfs��hive��hbase��jms�ȣ�������־������

1.5 Flume Agent�ڲ�ԭ��

1.6 Flume��װ

- ��ѹ

apache-flume-1.7.0-bin.tar.gz��/opt/module/Ŀ¼��

[root@hadoop100 software]$ tar -zxf apache-flume-1.7.0-bin.tar.gz -C

/opt/module/

2.����conf�µ�flume-env.sh.templateΪflume-env.sh��������JAVA_HOME

[root@hadoop100 conf]$ mv flume-env.sh.template flume-env.sh

[root@hadoop100 conf]$ vi flume-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

������ҵ��������

2.1 ��ض˿�����

�������� ��������Flume����ر���44444�˿ڣ�����ˣ�Ȼ��ͨ��netcat������44444�˿ڷ�����Ϣ���ͻ��ˣ����Flume������������ʵʱ��ʾ�ڿ���̨��

ʵ�ֲ��裺

�� ����Flume Agent�����ļ�flume-netcat-logger.conf

- ��

FlumeĿ¼�´���Job�ļ��в�����Job�ļ���

[root@hadoop100 flume]# mkdir job

[root@hadoop100 flume]# cd job/

- ����

Flume Agent�����ļ�flume-netcat-logger.conf

[root@hadoop100 flume]# vim flume-netcat-logger.conf

# Name the components on this agent

# a1 :��ʾagent������

a1.sources = r1 #r1 :��ʾa1������Դ

a1.sinks = k1 #k1 :��ʾa1�����Ŀ�ĵ�

a1.channels = c1 #c1����ʾa1�Ļ�����# Describe/configure the source

a1.sources.r1.type = netcat #��ʾa1������Դ����Ϊnetcat�˿�����

a1.sources.r1.bind = localhost #��ʾa1�ļ���������

a1.sources.r1.port = 44444 #��ʾa1�ļ����Ķ˿ں�# Describe the sink

a1.sinks.k1.type = logger #��ʾa1�����Ŀ�ĵ��ǿ���̨logger����# Use a channel which buffers events in memory

a1.channels.c1.type = memory #��ʾa1��channel������memory�ڴ���

a1.channels.c1.capacity = 1000 #��ʾal��channel������1000��event

#��ʾa1��channel����ʱ�ռ�����100��event�Ժ���ȥ�ύ����

a1.channels.c1.transactionCapacity = 100 # Bind the source and sink to the channel

a1.sources.r1.channels = c1 #��ʾ��r1��c1��������

a1.sinks.k1.channel = c1 # ��ʾ��k1��c1��������

�ڿ���Flume�����˿�

��һ��д����

[root@hadoop100 flume]# bin/flume-ng agent --conf conf/ --name a1

--conf-file job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

�ڶ���д����

[root@hadoop100 flume]$ bin/flume-ng agent -c conf/ -n a1 �Cf

job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

����˵����

--conf conf/����ʾ�����ļ��洢��conf/Ŀ¼--name a1����ʾ��agent����Ϊa1--conf-file job/flume-netcat.conf��flume����������ȡ�������ļ�����job�ļ����µ�flume-telnet.conf�ļ���-Dflume.root.logger==INFO,console��-D��ʾflume����ʱ��̬��flume.root.logger��������ֵ����������̨��־��ӡ��������ΪINFO������־�������:log��info��warn��error��

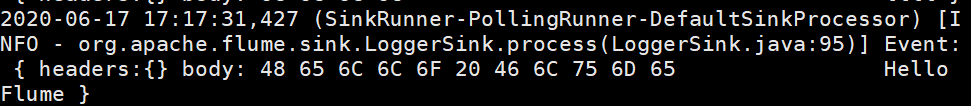

�� ʹ��netcat������44444�˿ڷ�������

[root@hadoop100 flume]$ nc localhost 44444

Hello Flume

����Flume����ҳ��۲�����������

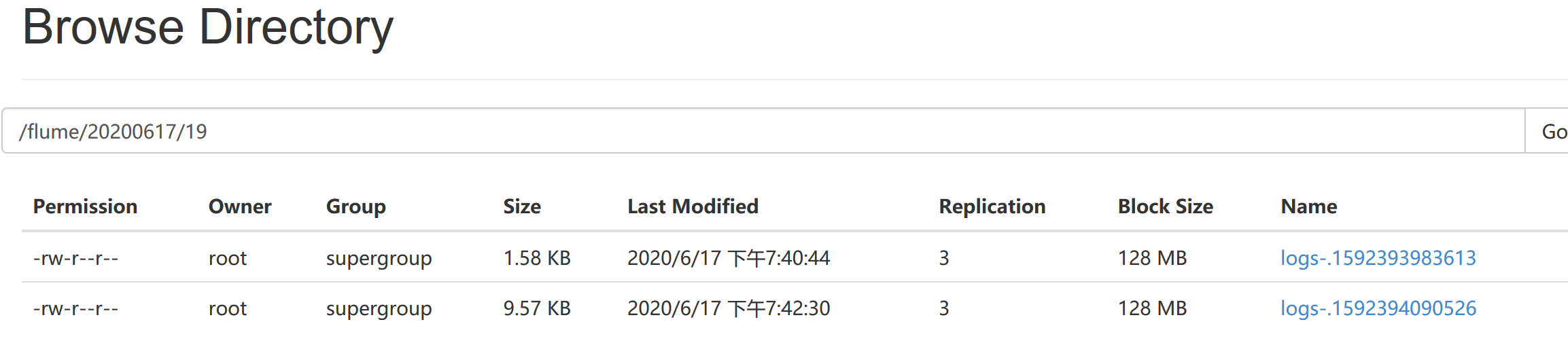

2.2 ʵʱ��ȡ�����ļ���HDFS

�������� ʵʱ���Hive��־�����ϴ���HDFS��

ʵ�ֲ��裺

��FlumeҪ�뽫���������HDFS���������Hadoop���jar��

��commons-configuration-1.6.jar��hadoop-auth-2.7.2.jar��hadoop-common-2.7.2.jar��hadoop-hdfs-2.7.2.jar��commons-io-2.4.jar��htrace-core-3.1.0-incubating.jar������/opt/module/flume/lib�ļ����¡�

�ڴ���flume-file-hdfs.conf�ļ�

�������£�

# Name the components on this agent

a2.sources = r2

a2.sinks = k2

a2.channels = c2# Describe/configure the source

a2.sources.r2.type = exec

a2.sources.r2.command = tail -F /opt/module/hive-1.2.1/logs/hive.log

a2.sources.r2.shell = /bin/bash -c# Describe the sink

a2.sinks.k2.type = hdfs

a2.sinks.k2.hdfs.path = hdfs://hadoop100:9000/flume/%Y%m%d/%H

#�ϴ��ļ���ǰ

a2.sinks.k2.hdfs.filePrefix = logs-

#�Ƿ���ʱ������ļ���

a2.sinks.k2.hdfs.round = true

#����ʱ�䵥λ����һ���µ��ļ���

a2.sinks.k2.hdfs.roundValue = 1

#���¶���ʱ�䵥λ

a2.sinks.k2.hdfs.roundUnit = hour

#�Ƿ�ʹ�ñ���ʱ���

a2.sinks.k2.hdfs.useLocalTimeStamp = true

#���ܶ��ٸ�Event��flush��HDFSһ��

a2.sinks.k2.hdfs.batchSize = 1000

#�����ļ����ͣ���֧��ѹ��

a2.sinks.k2.hdfs.fileType = DataStream

#�������һ���µ��ļ�

a2.sinks.k2.hdfs.rollInterval = 60

#����ÿ���ļ��Ĺ�����С

a2.sinks.k2.hdfs.rollSize = 134217700

#�ļ��Ĺ�����Event������

a2.sinks.k2.hdfs.rollCount = 0# Use a channel which buffers events in memory

a2.channels.c2.type = memory

a2.channels.c2.capacity = 1000

a2.channels.c2.transactionCapacity = 100# Bind the source and sink to the channel

a2.sources.r2.channels = c2

a2.sinks.k2.channel = c2

ע�⣺����������ʱ����ص�ת�����У�Event Header�б��������"timestamp"��key������hdfs.useLocalTimeStamp����Ϊtrue���˷�����ʹ��TimestampInterceptor�Զ�����timestamp����������a3.sinks.k3.hdfs.useLocalTimeStamp = true��

�� ִ�м������

[root@hadoop100 flume]# bin/flume-ng agent --conf conf/ --name a2

--conf-file job/flume-file-hdfs.conf

�ܿ���Hadoop��Hive������Hive������־

[root@hadoop100 hadoop-2.7.2]$ sbin/start-dfs.sh

[root@hadoop101 hadoop-2.7.2]$ sbin/start-yarn.sh[root@hadoop100 hive]$ bin/hive

hive (default)>

����HDFS�ϲ鿴�ļ�

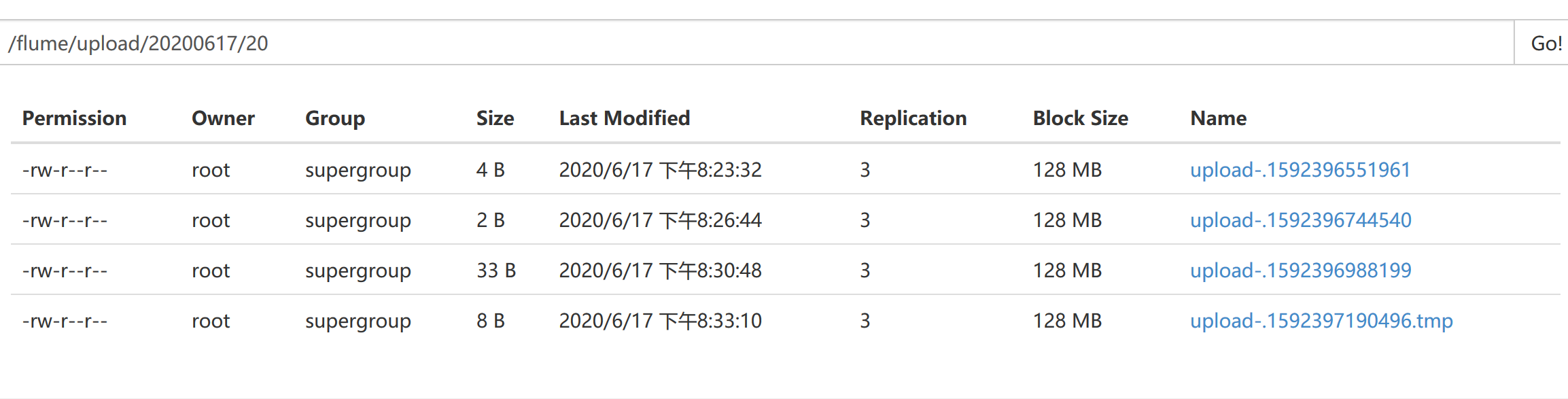

2.3 ʵʱ��ȡĿ¼�ļ���HDFS

�������� ʹ��Flume��������Ŀ¼���ļ�

ʵ�ֲ��裺

�� ���������ļ�flume-dir-hdfs.conf

a3.sources = r3

a3.sinks = k3

a3.channels = c3# Describe/configure the source

a3.sources.r3.type = spooldir

#��صĵ�ַ

a3.sources.r3.spoolDir = /opt/module/flume-1.7.0/upload

a3.sources.r3.fileSuffix = .COMPLETED

a3.sources.r3.fileHeader = true

#����������.tmp��β���ļ������ϴ�

a3.sources.r3.ignorePattern = ([^ ]*\.tmp)# Describe the sink

a3.sinks.k3.type = hdfs

#�ļ��ϴ���hdfs��·��

a3.sinks.k3.hdfs.path = hdfs://hadoop100:9000/flume/upload/%Y%m%d/%H

#�ϴ��ļ���ǰ

a3.sinks.k3.hdfs.filePrefix = upload-

#�Ƿ���ʱ������ļ���

a3.sinks.k3.hdfs.round = true

#����ʱ�䵥λ����һ���µ��ļ���

a3.sinks.k3.hdfs.roundValue = 1

#���¶���ʱ�䵥λ

a3.sinks.k3.hdfs.roundUnit = hour

#�Ƿ�ʹ�ñ���ʱ���

a3.sinks.k3.hdfs.useLocalTimeStamp = true

#���ܶ��ٸ�Event��flush��HDFSһ��

a3.sinks.k3.hdfs.batchSize = 100

#�����ļ����ͣ���֧��ѹ��

a3.sinks.k3.hdfs.fileType = DataStream

#�������һ���µ��ļ�

a3.sinks.k3.hdfs.rollInterval = 60

#����ÿ���ļ��Ĺ�����С�����128M

a3.sinks.k3.hdfs.rollSize = 134217700

#�ļ��Ĺ�����Event������

a3.sinks.k3.hdfs.rollCount = 0# Use a channel which buffers events in memory

a3.channels.c3.type = memory

a3.channels.c3.capacity = 1000

a3.channels.c3.transactionCapacity = 100# Bind the source and sink to the channel

a3.sources.r3.channels = c3

a3.sinks.k3.channel = c3

����������ļ�������

[root@hadoop100 flume]$ bin/flume-ng agent --conf conf/ --name a3 --conf-file job/flume-dir-hdfs.conf

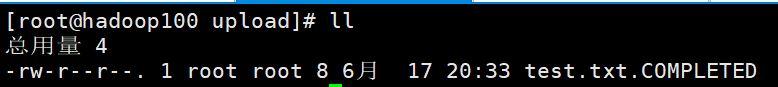

˵����

�Ӵ���ʽ

- ��Ҫ�ڼ��Ŀ¼�д������������ļ�

- �ϴ���ɵ��ļ�����

.COMPLETED��β - ������ļ���ÿ500����ɨ��һ���ļ��䶯

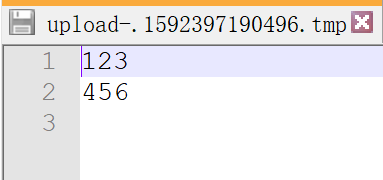

����upload�ļ����������ļ�

[root@hadoop100 flume]$ mkdir upload

[root@hadoop100 upload]$ vim test.txt

123

456

�۲鿴HDFS�ϵ�����

��

��

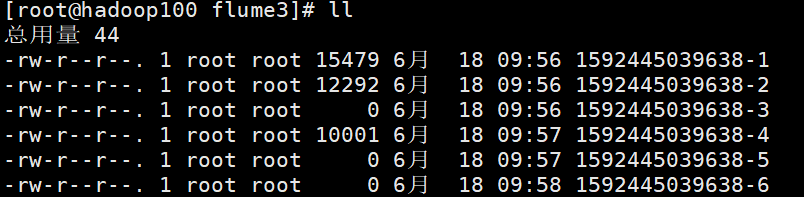

�ܲ鿴upload�ļ���

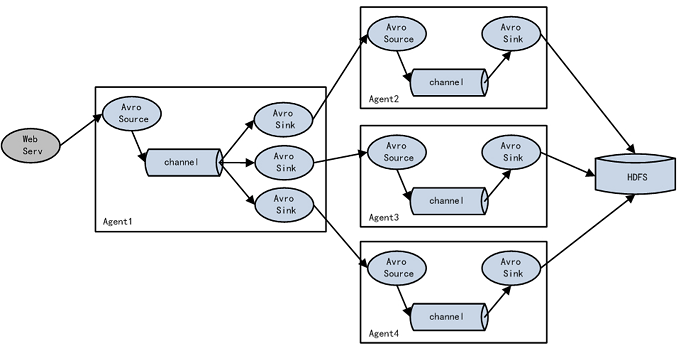

2.4 ������Դ����ڰ���(ѡ����)

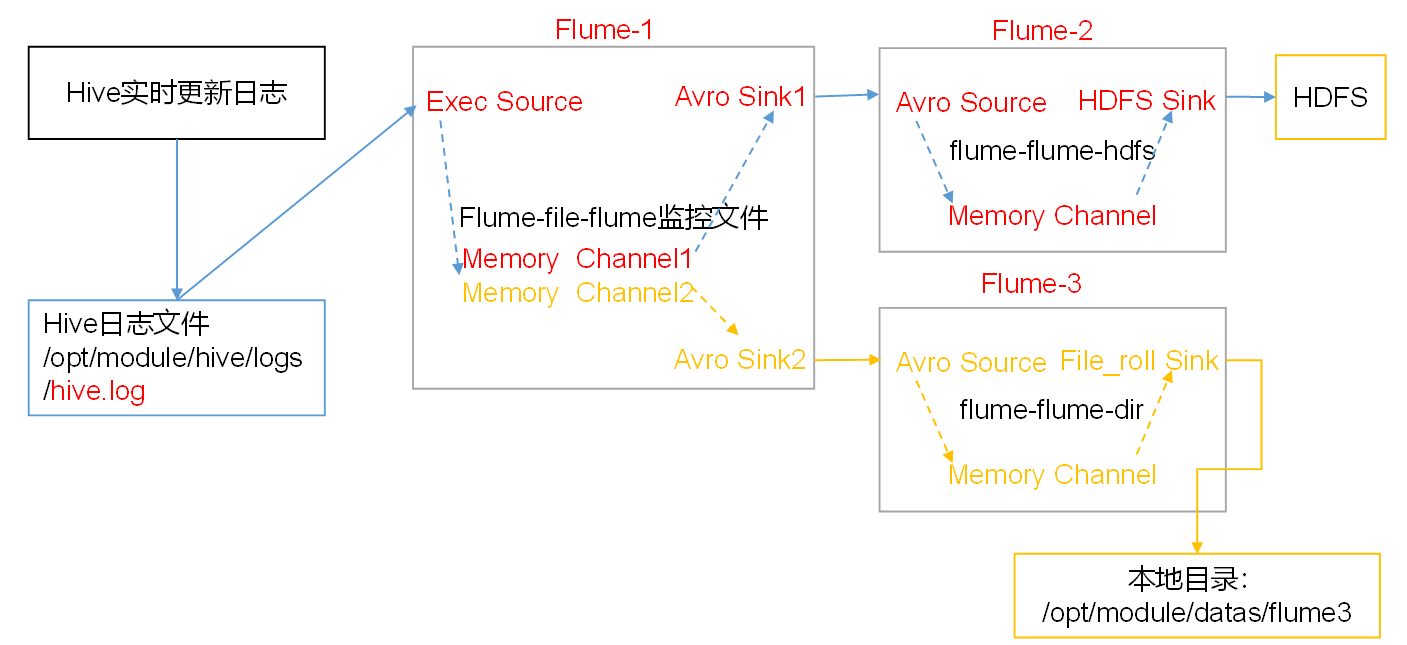

�������� ʹ��Flume-1����ļ��䶯��Flume-1���䶯���ݴ��ݸ�Flume-2��Flume-2����洢��HDFS��ͬʱFlume-1���䶯���ݴ��ݸ�Flume-3��Flume-3���������Local FileSystem��

ʵ�ֲ��裺

��������

��/opt/module/flume/jobĿ¼�´���group1�ļ��У�

[root@hadoop100 job]# mkdir group1/

��/opt/module/data/Ŀ¼�´���flume3�ļ���

[root@hadoop100 data]# mkdir flume3

�ڴ���flume-file-flume.conf

����1��������־�ļ���source������channel������sink���ֱ�����flume-flume-hdfs��flume-flume-dir��

# Name the components on this agent

a1.sources = r1

a1.sinks = k1 k2

a1.channels = c1 c2

# �����������Ƹ�����channel

a1.sources.r1.selector.type = replicating# Describe/configure the source

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /opt/module/hive-1.2.1/logs/hive.log

a1.sources.r1.shell = /bin/bash -c# Describe the sink

# sink�˵�avro��һ�����ݷ�����

a1.sinks.k1.type = avro

a1.sinks.k1.hostname = hadoop100

a1.sinks.k1.port = 4141a1.sinks.k2.type = avro

a1.sinks.k2.hostname = hadoop100

a1.sinks.k2.port = 4142# Describe the channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100a1.channels.c2.type = memory

a1.channels.c2.capacity = 1000

a1.channels.c2.transactionCapacity = 100# Bind the source and sink to the channel

a1.sources.r1.channels = c1 c2

a1.sinks.k1.channel = c1

a1.sinks.k2.channel = c2

ע��Avro����Hadoop��ʼ��Doug Cutting������һ�������ص��������л���RPC��ܡ�

�۴���flume-flume-hdfs.conf

�����ϼ�Flume�����Source������ǵ�HDFS��Sink��

# Name the components on this agent

a1.sources = r1

a1.sinks = k1 k2

a1.channels = c1 c2

# �����������Ƹ�����channel

a1.sources.r1.selector.type = replicating# Describe/configure the source

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /opt/module/hive-1.2.1/logs/hive.log

a1.sources.r1.shell = /bin/bash -c# Describe the sink

# sink�˵�avro��һ�����ݷ�����

a1.sinks.k1.type = avro

a1.sinks.k1.hostname = hadoop100

a1.sinks.k1.port = 4141a1.sinks.k2.type = avro

a1.sinks.k2.hostname = hadoop100

a1.sinks.k2.port = 4142# Describe the channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100a1.channels.c2.type = memory

a1.channels.c2.capacity = 1000

a1.channels.c2.transactionCapacity = 100# Bind the source and sink to the channel

a1.sources.r1.channels = c1 c2

a1.sinks.k1.channel = c1

a1.sinks.k2.channel = c2[root@hadoop100 group1]#

[root@hadoop100 group1]# cat flume-flume-hdfs.conf

# Name the components on this agent

a2.sources = r1

a2.sinks = k1

a2.channels = c1# Describe/configure the source

# source�˵�avro��һ�����ݽ��շ���

a2.sources.r1.type = avro

a2.sources.r1.bind = hadoop100

a2.sources.r1.port = 4141# Describe the sink

a2.sinks.k1.type = hdfs

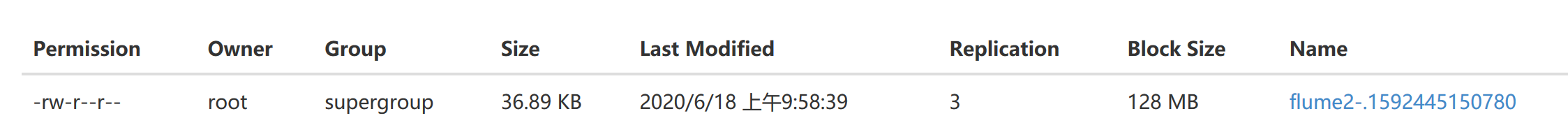

a2.sinks.k1.hdfs.path = hdfs://hadoop100:9000/flume2/%Y%m%d/%H

#�ϴ��ļ���ǰ

a2.sinks.k1.hdfs.filePrefix = flume2-

#�Ƿ���ʱ������ļ���

a2.sinks.k1.hdfs.round = true

#����ʱ�䵥λ����һ���µ��ļ���

a2.sinks.k1.hdfs.roundValue = 1

#���¶���ʱ�䵥λ

a2.sinks.k1.hdfs.roundUnit = hour

#�Ƿ�ʹ�ñ���ʱ���

a2.sinks.k1.hdfs.useLocalTimeStamp = true

#���ܶ��ٸ�Event��flush��HDFSһ��

a2.sinks.k1.hdfs.batchSize = 100

#�����ļ����ͣ���֧��ѹ��

a2.sinks.k1.hdfs.fileType = DataStream

#�������һ���µ��ļ�

a2.sinks.k1.hdfs.rollInterval = 600

#����ÿ���ļ��Ĺ�����С�����128M

a2.sinks.k1.hdfs.rollSize = 134217700

#�ļ��Ĺ�����Event������

a2.sinks.k1.hdfs.rollCount = 0# Describe the channel

a2.channels.c1.type = memory

a2.channels.c1.capacity = 1000

a2.channels.c1.transactionCapacity = 100# Bind the source and sink to the channel

a2.sources.r1.channels = c1

a2.sinks.k1.channel = c1

�ܴ���flume-flume-dir.conf

�����ϼ�Flume�����Source������ǵ�����Ŀ¼��Sink��

# Name the components on this agent

a3.sources = r1

a3.sinks = k1

a3.channels = c2# Describe/configure the source

a3.sources.r1.type = avro

a3.sources.r1.bind = hadoop100

a3.sources.r1.port = 4142# Describe the sink

a3.sinks.k1.type = file_roll

a3.sinks.k1.sink.directory = /opt/module/data/flume3# Describe the channel

a3.channels.c2.type = memory

a3.channels.c2.capacity = 1000

a3.channels.c2.transactionCapacity = 100# Bind the source and sink to the channel

a3.sources.r1.channels = c2

a3.sinks.k1.channel = c2

��ִ�������ļ�

[root@hadoop100 flume-1.7.0]$ bin/flume-ng agent --conf conf/ --name a3--conf-file job/group1/flume-flume-dir.conf[root@hadoop100 flume-1.7.0]$ bin/flume-ng agent --conf conf/ --name a2--conf-file job/group1/flume-flume-hdfs.conf[root@hadoop100 flume-1.7.0]$ bin/flume-ng agent --conf conf/ --name a1--conf-file job/group1/flume-file-flume.conf��ִ��Hive����

[root@hadoop100 hive]$ bin/hive

hive (default)> select * from stu;

�������

HDFS��

���أ�

2.5 ������Դ����ڰ���(Sink��)

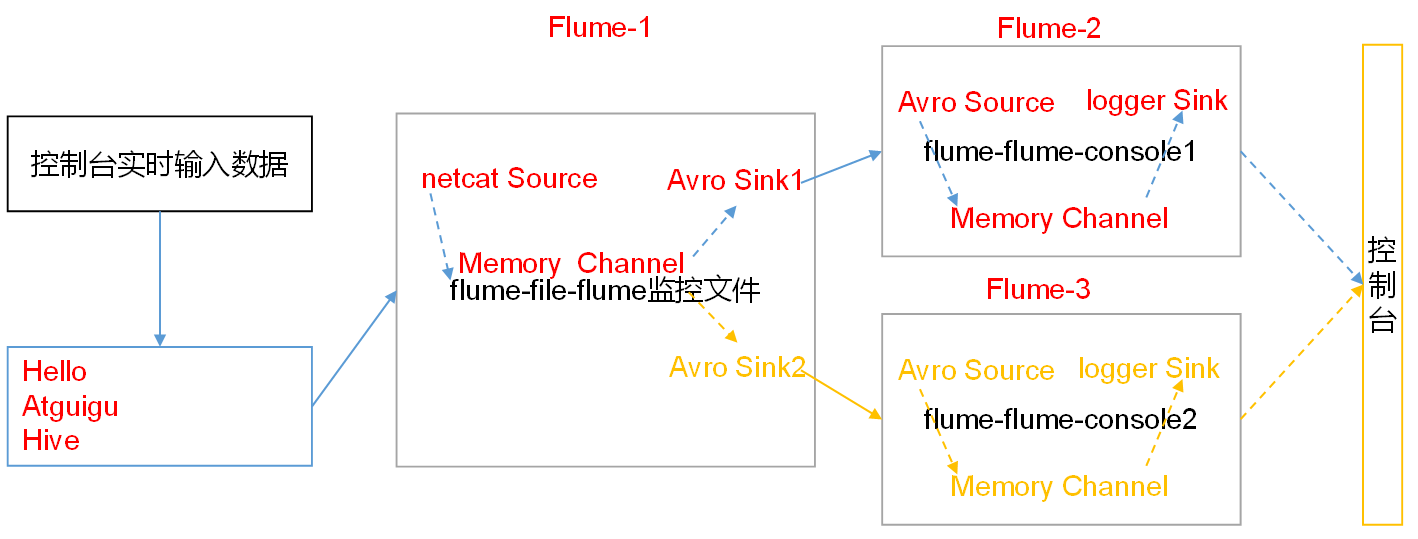

�������� ʹ��Flume-1��ؿ���̨ʵʱ�������ݣ�Flume-1��������ѵ�ֱݸ�Flume-2��Flume-3Ȼ���ڿ���̨��ӡ��

ʵ�ֲ��裺

��������

��/opt/module/flume/job��group2�ļ���

[root@hadoop100 job]# mkdir group2

�ڴ���flume-netcat-flume.conf

����1��������־�ļ���source��1��channel������sink���ֱ�����flume-flume-console1��flume-flume-console2��

# Name the components on this agent

a1.sources = r1

a1.channels = c1

a1.sinkgroups = g1

a1.sinks = k1 k2# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444a1.sinkgroups.g1.processor.type = load_balance

a1.sinkgroups.g1.processor.backoff = true

a1.sinkgroups.g1.processor.selector = round_robin

a1.sinkgroups.g1.processor.selector.maxTimeOut=10000# Describe the sink

a1.sinks.k1.type = avro

a1.sinks.k1.hostname = hadoop100

a1.sinks.k1.port = 4141a1.sinks.k2.type = avro

a1.sinks.k2.hostname = hadoop100

a1.sinks.k2.port = 4142# Describe the channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinkgroups.g1.sinks = k1 k2

a1.sinks.k1.channel = c1

a1.sinks.k2.channel = c1

�۴���flume-flume-console1.conf��flume-flume-console2.conf

�����ϼ�Flume�����Source������ǵ����ؿ���̨��

flume-flume-console1.conf��

# Name the components on this agent

a2.sources = r1

a2.sinks = k1

a2.channels = c1# Describe/configure the source

a2.sources.r1.type = avro

a2.sources.r1.bind = hadoop100

a2.sources.r1.port = 4141# Describe the sink

a2.sinks.k1.type = logger# Describe the channel

a2.channels.c1.type = memory

a2.channels.c1.capacity = 1000

a2.channels.c1.transactionCapacity = 100# Bind the source and sink to the channel

a2.sources.r1.channels = c1

a2.sinks.k1.channel = c1

flume-flume-console2.conf��

# Name the components on this agent

a3.sources = r1

a3.sinks = k1

a3.channels = c2# Describe/configure the source

a3.sources.r1.type = avro

a3.sources.r1.bind = hadoop100

a3.sources.r1.port = 4142# Describe the sink

a3.sinks.k1.type = logger# Describe the channel

a3.channels.c2.type = memory

a3.channels.c2.capacity = 1000

a3.channels.c2.transactionCapacity = 100# Bind the source and sink to the channel

a3.sources.r1.channels = c2

a3.sinks.k1.channel = c2

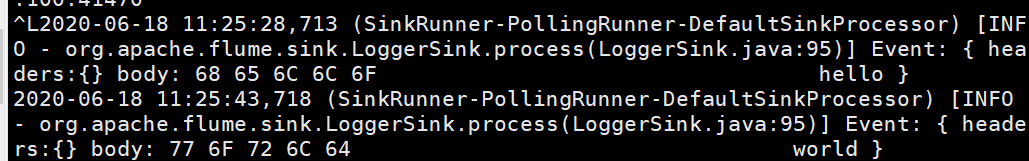

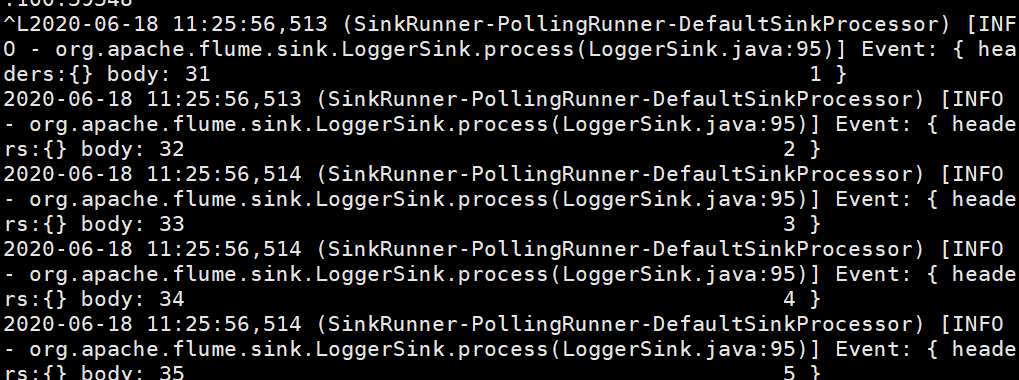

��ִ�������ļ�

[root@hadoop100 flume-1.7.0]# bin/flume-ng agent --conf conf/ --name a3

--conf-file job/group2/flume-flume-console2.conf

-Dflume.root.logger=INFO,console[root@hadoop100 flume-1.7.0]# bin/flume-ng agent --conf conf/ --name a2

--conf-file job/group2/flume-flume-console1.conf

-Dflume.root.logger=INFO,console[root@hadoop100 flume-1.7.0]# bin/flume-ng agent --conf conf/ --name a1

--conf-file job/group2/flume-netcat-flume.conf

�ݲ鿴Flume2��Flume3�Ŀ���̨��ӡ��־

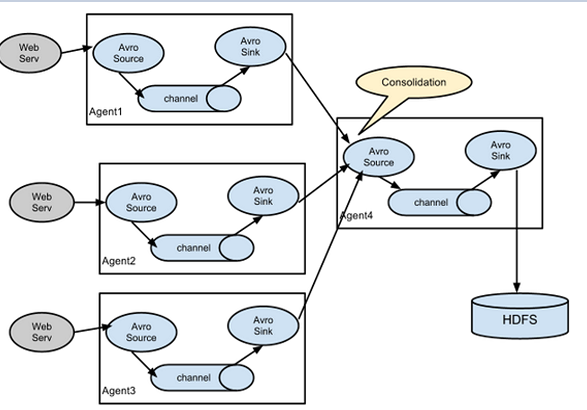

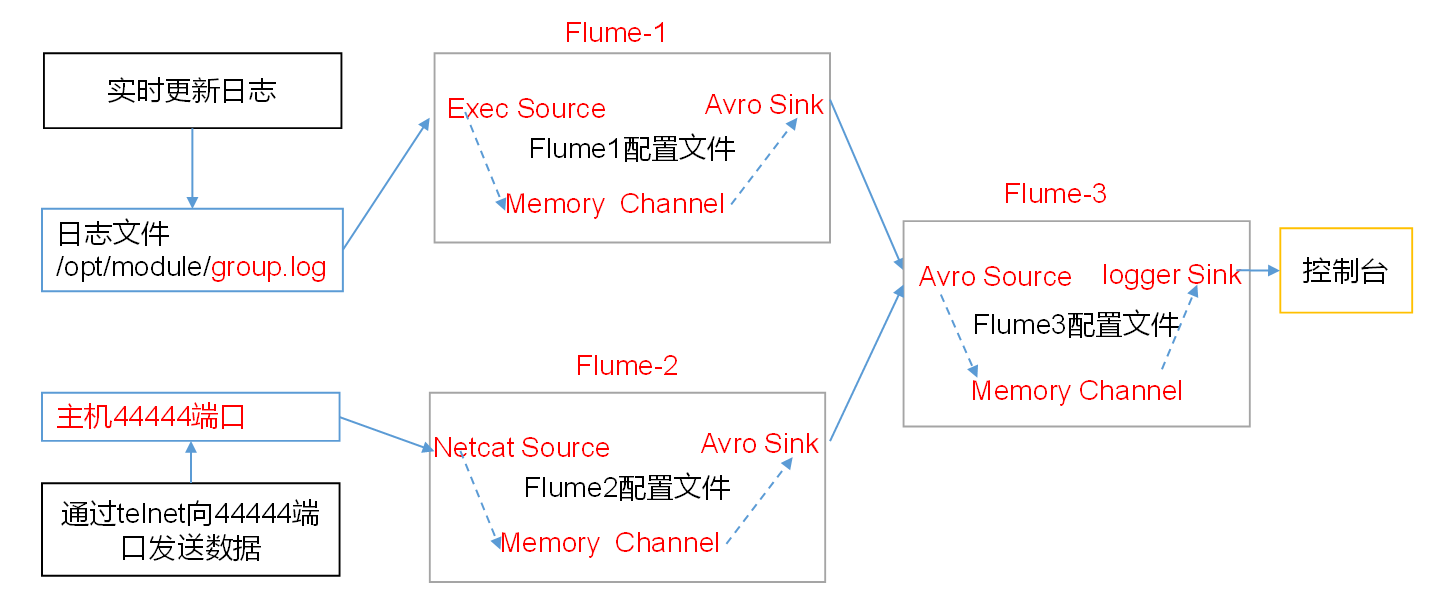

2.6 ������Դ���ܰ���

��������

Hadoop100�ϵ�Flume-1����ļ�/opt/module/group.log��

Hadoop101�ϵ�Flume-2���ijһ���˿ڵ���������

Flume-1��Flume-2�����ݷ���hadoop102�ϵ�Flume-3��Flume-3���������ݴ�ӡ������̨��

ʵ�ֲ��裺

��������

��/opt/module/flume/job��group3�ļ���

[root@hadoop100 job]# mkdir group3

�ڴ���flume1-logger-flume.conf

Hadoop100������Source���ڼ��hive.log�ļ�������Sink������ݵ���һ��Flume��

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1# Describe/configure the source

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /opt/module/hive-1.2.1/logs/hive.log

a1.sources.r1.shell = /bin/bash -c# Describe the sink

a1.sinks.k1.type = avro

a1.sinks.k1.hostname = hadoop102

a1.sinks.k1.port = 4141# Describe the channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

�۴���flume2-netcat-flume.conf

Hadoop101������Source��ض˿�44444������������Sink���ݵ���һ��Flume��

# Name the components on this agent

a2.sources = r1

a2.sinks = k1

a2.channels = c1# Describe/configure the source

a2.sources.r1.type = netcat

a2.sources.r1.bind = hadoop101

a2.sources.r1.port = 44444# Describe the sink

a2.sinks.k1.type = avro

a2.sinks.k1.hostname = hadoop102

a2.sinks.k1.port = 4141# Use a channel which buffers events in memory

a2.channels.c1.type = memory

a2.channels.c1.capacity = 1000

a2.channels.c1.transactionCapacity = 100# Bind the source and sink to the channel

a2.sources.r1.channels = c1

a2.sinks.k1.channel = c1

�ܴ���flume3-flume-logger.conf

Hadoop102������source���ڽ���flume1��flume2�������������������պϲ���sink������̨��

# Name the components on this agent

a3.sources = r1

a3.sinks = k1

a3.channels = c1# Describe/configure the source

a3.sources.r1.type = avro

a3.sources.r1.bind = hadoop102

a3.sources.r1.port = 4141# Describe the sink

# Describe the sink

a3.sinks.k1.type = logger# Describe the channel

a3.channels.c1.type = memory

a3.channels.c1.capacity = 1000

a3.channels.c1.transactionCapacity = 100# Bind the source and sink to the channel

a3.sources.r1.channels = c1

a3.sinks.k1.channel = c1

��ִ�������ļ�

[root@hadoop102 flume-1.7.0]# bin/flume-ng agent --conf conf/ --name a3

--conf-file job/group3/flume3-flume-logger.conf-Dflume.root.logger=INFO,console[root@hadoop101 flume-1.7.0]# bin/flume-ng agent --conf conf/ --name a2

--conf-file job/group3/flume2-netcat-flume.conf[root@hadoop100 flume-1.7.0]# bin/flume-ng agent --conf conf/ --name a1

--conf-file job/group3/flume1-logger-flume.conf