2020 CVPR oral

《Unbiased Scene Graph Generation from Biased Training》

作者博文:https://mp.weixin.qq.com/s/wLsVyyhP9jjBoj1FMgy3xg

文章目录

-

-

- 《Unbiased Scene Graph Generation from Biased Training》

-

- 针对问题

- 本文创新

- SGG算法结构

- 实验结果

- 实验细节

-

针对问题

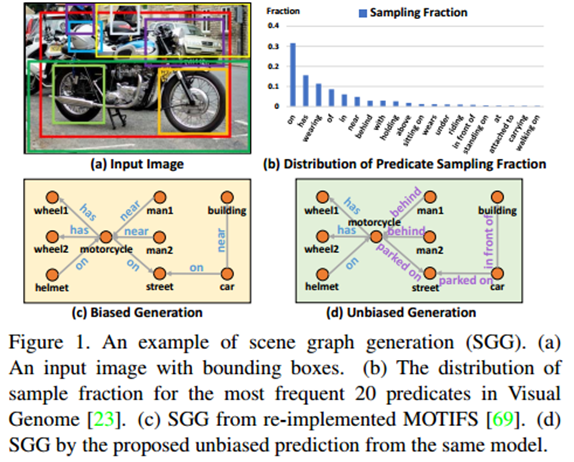

由于VG数据的长尾效应,大部分SGG方法中网络更关注label信息,而没有很好的利用视觉信息,这就相当于仅根据label盲猜(Motif里的baseline)

导致的结果就是,具体的visual feature不再重要,也就预测不出真正有意义的finegrain的relationships了。因为更finegrain的relation出现太少,而且很容易错,所以干脆把所有复杂的sitting on/standing on/riding全预测成on。

本文创新

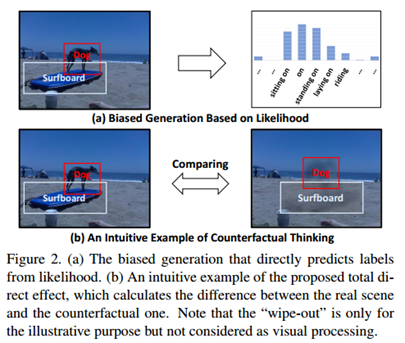

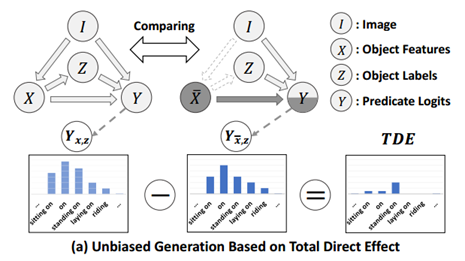

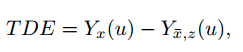

提出了反因果事实的推断方法causal inference(不是训练方法),其借鉴了因果推理的思想,使用Total Direct Effect(TDE)来取代单纯的网络log-likelihood,简单来说就是用 初始预测结果 减去 控制变量得到的预测结果(偏差) 得到 最终预测(无偏差预测)

本文中认为VG数据集的长尾效应会导致网络过于偏向label信息而忽视了视觉具体信息,因此认为 不输入视觉特征时得到的预测为偏差(bias),使用初始的预测减去这个bias得到最终预测

SGG算法结构

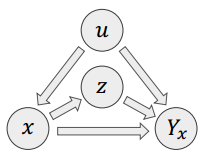

SGG算法结构大多都可以概括为下图的结构:

其中u表示图像,x表示RoI feature(即目标特征,这里x表示目标对),z表示目标label(由x预测得到),这三者再结合用于预测关系谓词Y_x

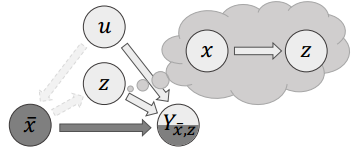

Counterfactual

反事实推测

去除视觉特征输入,使用平均特征或者0特征代替视觉特征,依据label + image预测关系谓词,得到预测结果Y_x(―),z,被认为是bias

TDE结果:将上述两者相减即可

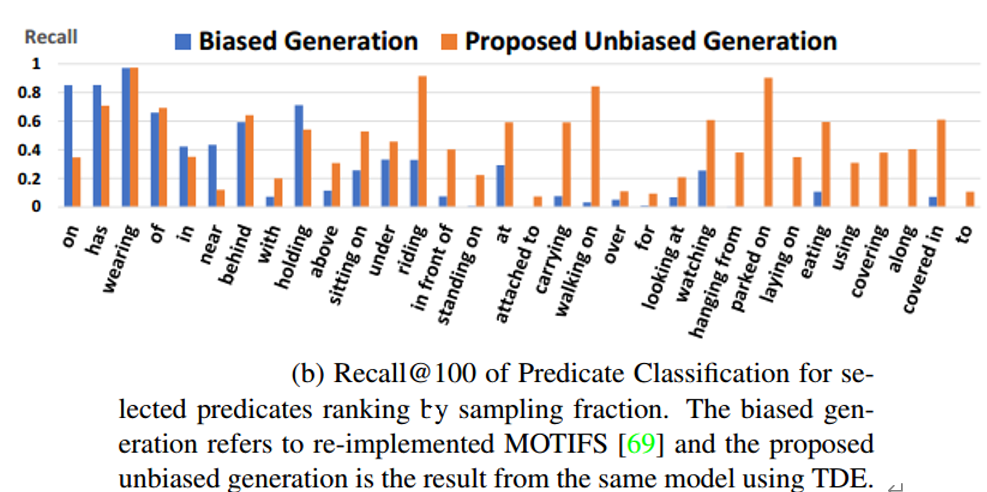

实验结果

可以看出长尾效应减弱了很多

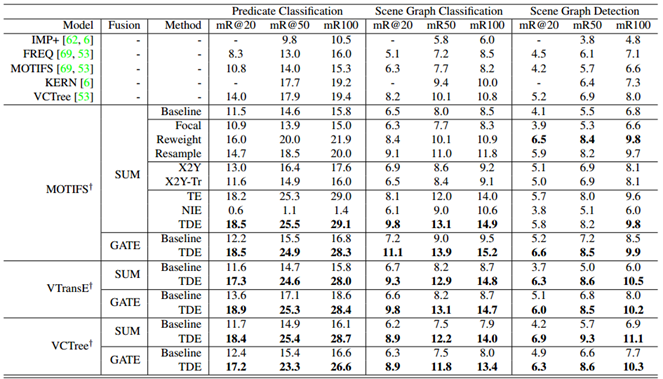

可以看出添加了本文的方法后有很大的提升

其中Fusion表示在计算Y时X,Z,I三者的融合方式,作者提到了两种:

评价指标 作者使用的是VCTree中提出的mean Recall@K

实验细节

论文中使用了相当大的篇幅说明实验细节等等,这部分后续看完再补

写在最后:本文的思想其实很简单,但是目前看起来很有效啊,并且方法也很容易迁移到其他方法上