Ŀ¼

- ǰ��

- 0��������Ҫ�İ��ͻ�������

- 1��parse_model

- 2��Detect

- 3��Model

- �ܽ�

ǰ��

Դ�룺 YOLOv5Դ��.

����: ��YOLOV5-5.x Դ�뽲�⡿������Ŀ�ļ�����.

ע�Ͱ�ȫ����Ŀ�ļ����ϴ���GitHub: yolov5-5.x-annotations.

\qquad���ģ����yolov5��ģ�ʹģ�飬�dz�����Ҫ�������������������Ǻ��ѣ�ֻ��yolov5�����߰ѷ�װ��̫���ˣ�ģ����չ�˺ܶ�Ķ���Ĺ��ܣ����¿��������ѣ���ʵ�������õĴ��벻��ġ��ص���ץס������������������õģ�˭����˭�ģ��������Ӧ�þͲ�����ѡ�

0��������Ҫ�İ��ͻ�������

import argparse # ���������в���ģ��

import logging # ��־ģ��

import sys # sysϵͳģ�� ��������Python�����������Ļ����йصĺ���

from copy import deepcopy # ���ݿ���ģ�� ���

from pathlib import Path # Path��strת��ΪPath���� ʹ�ַ���·�����ڲ�����ģ��FILE = Path(__file__).absolute() # FILE = WindowsPath 'F:\yolo_v5\yolov5-U\modles\yolo.py'

# ��'F:/yolo_v5/yolov5-U'����ϵͳ�Ļ������� �ýű�������ʧЧ

sys.path.append(FILE.parents[1].as_posix()) # add yolov5/ to pathfrom models.common import *

from models.experimental import *

from utils.autoanchor import check_anchor_order

from utils.general import make_divisible, check_file, set_logging

from utils.plots import feature_visualization

from utils.torch_utils import time_synchronized, fuse_conv_and_bn, model_info, \scale_img, initialize_weights, select_device, copy_attr# ����thop�� ���ڼ���FLOPs

try:import thop # for FLOPs computation

except ImportError:thop = None

# ��ʼ����־

logger = logging.getLogger(__name__)

1��parse_model

\qquadparse_modelģ����������ģ���ļ�(��Model�д������ֵ���ʽ)���������ṹ��

parse_modelģ�����

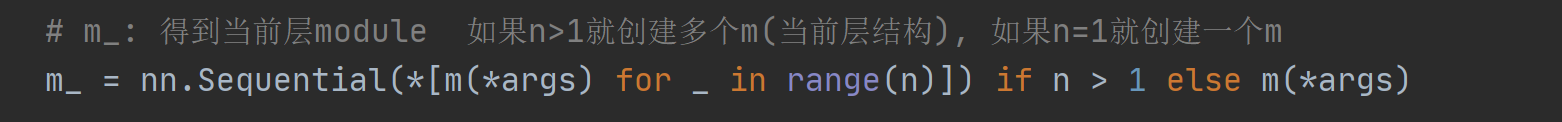

def parse_model(d, ch): # model_dict, input_channels(3)"""��������Modelģ���н���ģ���ļ�(�ֵ���ʽ)���������ṹ���������ʵ��Ҫ���ľ���: ���µ�ǰ���args��������,����c2����ǰ������channel�� =>ʹ�õ�ǰ��IJ������ǰ�� =>���� layers + save:params d: model_dict ģ���ļ� �ֵ���ʽ {dict:7} yolov5s.yaml�е�6��Ԫ�� + ch:params ch: ��¼ģ��ÿһ������channel ��ʼch=[3] �����ɾ��:return nn.Sequential(*layers): �����ÿһ��IJ�ṹ:return sorted(save): �����в�ṹ��from����-1��ֵ���� ������ [4, 6, 10, 14, 17, 20, 23]"""logger.info('\n%3s%18s%3s%10s %-40s%-30s' % ('', 'from', 'n', 'params', 'module', 'arguments'))# ��ȡd�ֵ��е�anchors��parameters(nc��depth_multiple��width_multiple)anchors, nc, gd, gw = d['anchors'], d['nc'], d['depth_multiple'], d['width_multiple']# na: number of anchors ÿһ��predict head�ϵ�anchor�� = 3na = (len(anchors[0]) // 2) if isinstance(anchors, list) else anchors# no: number of outputs ÿһ��predict head������channel = anchors * (classes + 5) = 75(VOC)no = na * (nc + 5)# ��ʼ�����# layers: ����ÿһ��IJ�ṹ# save: ��¼�����в�ṹ��from�в���-1�IJ�ṹ���# c2: ���浱ǰ������channellayers, save, c2 = [], [], ch[-1]# from(��ǰ������������Щ��), number(��ǰ����� ����), module(��ǰ�����), args(��ǰ������� ����)for i, (f, n, m, args) in enumerate(d['backbone'] + d['head']): # ����backbone��head��ÿһ��# eval(string) �õ���ǰ�����ʵ���� ����: m= Focus -> <class 'models.common.Focus'>m = eval(m) if isinstance(m, str) else m# ûʲô��for j, a in enumerate(args):try:args[j] = eval(a) if isinstance(a, str) else a # eval stringsexcept:pass# ------------------- ���µ�ǰ���args��������,����c2����ǰ������channel�� -------------------# depth gain ������� ��v5s: n*0.33 n: ��ǰģ��Ĵ���(��ӿ������)n = max(round(n * gd), 1) if n > 1 else nif m in [Conv, GhostConv, Bottleneck, GhostBottleneck, SPP, DWConv, MixConv2d,Focus, CrossConv, BottleneckCSP, C3, C3TR, CBAM]:# c1: ��ǰ��������channel�� c2: ��ǰ��������channel��(����) ch: ��¼�����в�����channelc1, c2 = ch[f], args[0]# if not output no=75 ֻ�����һ��c2=no ���һ�㲻�ÿ��ƿ��ȣ����channel������noif c2 != no:# width gain ���ƿ��� ��v5s: c2*0.5 c2: ��ǰ������������channel��(��ӿ��ƿ���)c2 = make_divisible(c2 * gw, 8)# �ڳ�ʼarg�Ļ����ϸ��� ���뵱ǰ�������channel�����µ�ǰ��# [in_channel, out_channel, *args[1:]]args = [c1, c2, *args[1:]]# �����ǰ����BottleneckCSP/C3/C3TR, ����Ҫ��args�м���bottleneck�ĸ���# [in_channel, out_channel, Bottleneck�ĸ���n, bool(True��ʾ��shortcut Ĭ�ϣ���֮��)]if m in [BottleneckCSP, C3, C3TR]:args.insert(2, n) # �ڵڶ���λ�ò���bottleneck����nn = 1 # �ָ�Ĭ��ֵ1elif m is nn.BatchNorm2d:# BN��ֻ��Ҫ������һ������channelargs = [ch[f]]elif m is Concat:# Concat����f�����е�����ۼӵõ��������channelc2 = sum([ch[x] for x in f])elif m is Detect: # Detect��YOLO Layer����# ��args�м�������Detect������channelargs.append([ch[x] for x in f])if isinstance(args[1], int): # number of anchors ������ִ��args[1] = [list(range(args[1] * 2))] * len(f)elif m is Contract: # ����ô��c2 = ch[f] * args[0] ** 2elif m is Expand: # ����ô��c2 = ch[f] // args[0] ** 2elif m is SELayer: # ����SEģ��channel, re = args[0], args[1]channel = make_divisible(channel * gw, 8) if channel != no else channelargs = [channel, re]else:# Upsamplec2 = ch[f] # args����# -----------------------------------------------------------------------------------# m_: �õ���ǰ��module ���n>1�ʹ������m(��ǰ��ṹ), ���n=1�ʹ���һ��mm_ = nn.Sequential(*[m(*args) for _ in range(n)]) if n > 1 else m(*args)# ��ӡ��ǰ��ṹ��һЩ������Ϣt = str(m)[8:-2].replace('__main__.', '') # t = module type 'modules.common.Focus'np = sum([x.numel() for x in m_.parameters()]) # number params ������һ��IJ�����m_.i, m_.f, m_.type, m_.np = i, f, t, np # index, 'from' index, number, type, number paramslogger.info('%3s%18s%3s%10.0f %-40s%-30s' % (i, f, n, np, t, args)) # print# append to savelist �����в�ṹ��from����-1��ֵ���� [6, 4, 14, 10, 17, 20, 23]save.extend(x % i for x in ([f] if isinstance(f, int) else f) if x != -1)# ����ǰ��ṹmodule����layers��layers.append(m_)if i == 0:ch = [] # ȥ������channel [3]# �ѵ�ǰ������channel������chch.append(c2)return nn.Sequential(*layers), sorted(save)

��Modelģ���__init__�����е��ã�

2��Detect

\qquadDetectģ������������Detect��ģ�������feature map ͨ��һ������������ʽ���㵽������Ҫ��shape��Ϊ����ļ�����ʧ����NMS������

Detectģ����룺

class Detect(nn.Module):"""Detectģ������������Detect��ģ�������feature map ͨ��һ������������ʽ���㵽������Ҫ��shape, Ϊ����ļ�����ʧ����NMS����"""stride = None # strides computed during buildonnx_dynamic = False # ONNX export parameterdef __init__(self, nc=80, anchors=(), ch=(), inplace=True):"""detection layer �൱��yolov3�е�YOLOLayer��:params nc: number of classes:params anchors: ����3��feature map�ϵ�����anchor�Ĵ�С��P3��P4��P5��:params ch: [128, 256, 512] 3�����feature map��channel"""super(Detect, self).__init__()self.nc = nc # number of classes VOC: 20self.no = nc + 5 # number of outputs per anchor VOC: 5+20=25 xywhc+20classesself.nl = len(anchors) # number of detection layers Detect�ĸ��� 3self.na = len(anchors[0]) // 2 # number of anchors ÿ��feature map��anchor���� 3self.grid = [torch.zeros(1)] * self.nl # init grid {list: 3} tensor([0.]) X 3# a=[3, 3, 2] anchors��[w, h]�Ե���ʽ�洢 3��feature map ÿ��feature map��������anchor��w,h��a = torch.tensor(anchors).float().view(self.nl, -1, 2)# register_buffer# ģ������Ҫ����IJ���һ�������֣�һ���Ƿ�����Ҫ��optimizer���µģ���Ϊparameter; ��һ�ֲ�Ҫ�����³�Ϊbuffer# buffer�IJ�����������forward�У���optim.stepֻ�ܸ���nn.parameter���͵IJ���# shape(nl,na,2)self.register_buffer('anchors', a)# shape(nl,1,na,1,1,2)self.register_buffer('anchor_grid', a.clone().view(self.nl, 1, -1, 1, 1, 2))# output conv ��ÿ�������feature map��Ҫ����һ��conv1x1self.m = nn.ModuleList(nn.Conv2d(x, self.no * self.na, 1) for x in ch)# use in-place ops (e.g. slice assignment) һ�㶼��True Ĭ�ϲ�ʹ��AWS Inferentia����self.inplace = inplacedef forward(self, x):""":return train: һ��tensor list �������Ԫ�� [bs, anchor_num, grid_w, grid_h, xywh+c+20classes]�ֱ��� [1, 3, 80, 80, 25] [1, 3, 40, 40, 25] [1, 3, 20, 20, 25]inference: 0 [1, 19200+4800+1200, 25] = [bs, anchor_num*grid_w*grid_h, xywh+c+20classes]1 һ��tensor list �������Ԫ�� [bs, anchor_num, grid_w, grid_h, xywh+c+20classes][1, 3, 80, 80, 25] [1, 3, 40, 40, 25] [1, 3, 20, 20, 25]"""# x = x.copy() # for profilingz = [] # inference outputfor i in range(self.nl): # ������feature map�ֱ���д���x[i] = self.m[i](x[i]) # conv xi[bs, 128/256/512, 80, 80] to [bs, 75, 80, 80]bs, _, ny, nx = x[i].shape# [bs, 75, 80, 80] to [1, 3, 25, 80, 80] to [1, 3, 80, 80, 25]x[i] = x[i].view(bs, self.na, self.no, ny, nx).permute(0, 1, 3, 4, 2).contiguous()# inferenceif not self.training:# ��������# ��Ϊ�������صIJ��ǹ�һ���������ƫ���� ��Ҫ�ټ��������λ�� �õ����յ��������� ������nms# �������ﹹ���������Ϊ�˼���ÿ��grid���������� �������ʹ��if self.grid[i].shape[2:4] != x[i].shape[2:4] or self.onnx_dynamic:self.grid[i] = self._make_grid(nx, ny).to(x[i].device)y = x[i].sigmoid()if self.inplace:# Ĭ��ִ�� ��ʹ��AWS Inferentia# ����Ĺ�ʽ��yolov3��v4��ʹ�õIJ�һ�� ��yolov5�����Լ��õ� Ч������y[..., 0:2] = (y[..., 0:2] * 2. - 0.5 + self.grid[i]) * self.stride[i] # xy# y[..., 2:4] = torch.exp(y[..., 2:4]) * self.anchor_wh # wh yolo methody[..., 2:4] = (y[..., 2:4] * 2) ** 2 * self.anchor_grid[i] # wh power methodelse: # for YOLOv5 on AWS Inferentia https://github.com/ultralytics/yolov5/pull/2953xy = (y[..., 0:2] * 2. - 0.5 + self.grid[i]) * self.stride[i] # xywh = (y[..., 2:4] * 2) ** 2 * self.anchor_grid[i].view(1, self.na, 1, 1, 2) # why = torch.cat((xy, wh, y[..., 4:]), -1)# z��һ��tensor list ����Ԫ�� �ֱ���[1, 19200, 25] [1, 4800, 25] [1, 1200, 25]z.append(y.view(bs, -1, self.no))return x if self.training else (torch.cat(z, 1), x)@staticmethoddef _make_grid(nx=20, ny=20):"""��������"""yv, xv = torch.meshgrid([torch.arange(ny), torch.arange(nx)])return torch.stack((xv, yv), 2).view((1, 1, ny, nx, 2)).float()

__init__������parse_model�����е��ã�

forward������Model���forward_once�е��ã�

3��Model

\qquad���ģ��������ģ�͵Ĵģ�顣��yolov5�����߽����ģ��Ĺ���д�ĺ�ȫ���������ģ�͵Ĵ������չ�˺ܶ���磺�������ӻ�����ӡģ����Ϣ��TTA������ǿ���ں�Conv+Bn����������ģ�ʹ���nms���ܡ�autoshape������ģ�Ͱ���ǰ������������������ģ��(Ԥ���� + ���� + nms)������Ȥ�Ŀ�����ϸ������������Ȥ�Ŀ���ֱ�ӿ�__init__��__forward__�����������ɡ�

Modelģ�����:

class Model(nn.Module):def __init__(self, cfg='yolov5s.yaml', ch=3, nc=None, anchors=None):""":params cfg:ģ�������ļ�:params ch: input img channels һ����3 RGB�ļ�:params nc: number of classes ���ݼ���������:anchors: һ����None"""super(Model, self).__init__()if isinstance(cfg, dict):self.yaml = cfg # model dictelse:# is *.yaml һ��ִ������import yaml # for torch hubself.yaml_file = Path(cfg).name # cfg file name = yolov5s.yaml# ��������ļ��������ģ���ʱҪ��encoding����with open(cfg, encoding='utf-8') as f:# model dict ȡ�������ļ���ÿ������Ϣ��û��ע�����ݣ�self.yaml = yaml.safe_load(f)# input channels ch=3ch = self.yaml['ch'] = self.yaml.get('ch', ch)# ��������� һ�㲻ִ��, ��Ϊnc=self.yaml['nc']�����if nc and nc != self.yaml['nc']:logger.info(f"Overriding model.yaml nc={

self.yaml['nc']} with nc={

nc}")self.yaml['nc'] = nc # override yaml value# ��дanchor��һ�㲻ִ��, ��Ϊ��������anchorsһ�㶼��Noneif anchors:logger.info(f'Overriding model.yaml anchors with anchors={

anchors}')self.yaml['anchors'] = round(anchors) # override yaml value# ��������ģ��# self.model: ��ʼ������������ģ��(����Detect��ṹ)# self.save: ���в�ṹ��from������-1����ţ����ź��� [4, 6, 10, 14, 17, 20, 23]self.model, self.save = parse_model(deepcopy(self.yaml), ch=[ch])# default class names ['0', '1', '2',..., '19']self.names = [str(i) for i in range(self.yaml['nc'])]# self.inplace=True Ĭ��True ��ʹ�ü�������# AWS Inferentia Inplace compatiability# https://github.com/ultralytics/yolov5/pull/2953self.inplace = self.yaml.get('inplace', True)# logger.info([x.shape for x in self.forward(torch.zeros(1, ch, 64, 64))])# ��ȡDetectģ���stride(�������ͼ����²�����)��anchors�ڵ�ǰDetect�����feature map�ij߶�m = self.model[-1] # Detect()if isinstance(m, Detect):s = 256 # 2x min stridem.inplace = self.inplace# ��������feature map�²����ı��� [8, 16, 32]m.stride = torch.tensor([s / x.shape[-2] for x in self.forward(torch.zeros(1, ch, s, s))]) # forward# �����Ե�ǰfeature map��anchor��С ��[10, 13]/8 -> [1.25, 1.625]m.anchors /= m.stride.view(-1, 1, 1)# ���anchor˳����stride˳���Ƿ�һ��check_anchor_order(m)self.stride = m.strideself._initialize_biases() # only run once ��ʼ��ƫ��# logger.info('Strides: %s' % m.stride.tolist())# Init weights, biasesinitialize_weights(self) # ����torch_utils.py��initialize_weights��ʼ��ģ��Ȩ��self.info() # ��ӡģ����Ϣlogger.info('')def forward(self, x, augment=False, profile=False):# augmented inference, None ����flip/����flip# �Ƿ��ڲ���ʱҲʹ��������ǿ Test Time Augmentation(TTA)if augment:return self.forward_augment(x)else:# Ĭ��ִ�� ����ǰ������# single-scale inference, trainreturn self.forward_once(x, profile)def forward_augment(self, x):"""TTA Test Time Augmentation"""img_size = x.shape[-2:] # height, widths = [1, 0.83, 0.67] # scales ratiof = [None, 3, None] # flips (2-ud����flip, 3-lr����flip)y = [] # outputsfor si, fi in zip(s, f):# scale_img����ͼƬ�ߴ�xi = scale_img(x.flip(fi) if fi else x, si, gs=int(self.stride.max()))yi = self.forward_once(xi)[0] # forward# cv2.imwrite(f'img_{si}.jpg', 255 * xi[0].cpu().numpy().transpose((1, 2, 0))[:, :, ::-1]) # save# _descale_pred����������ָ������ԭͼͼƬ�ߴ�yi = self._descale_pred(yi, fi, si, img_size)y.append(yi)return torch.cat(y, 1), None # augmented inference, traindef forward_once(self, x, profile=False, feature_vis=False):""":params x: ����ͼ��:params profile: True ������һЩ��������:params feature_vis: True ������һЩ�������ӻ�:return train: һ��tensor list �������Ԫ�� [bs, anchor_num, grid_w, grid_h, xywh+c+20classes]�ֱ��� [1, 3, 80, 80, 25] [1, 3, 40, 40, 25] [1, 3, 20, 20, 25]inference: 0 [1, 19200+4800+1200, 25] = [bs, anchor_num*grid_w*grid_h, xywh+c+20classes]1 һ��tensor list �������Ԫ�� [bs, anchor_num, grid_w, grid_h, xywh+c+20classes][1, 3, 80, 80, 25] [1, 3, 40, 40, 25] [1, 3, 20, 20, 25]"""# y: �����self.save=True��ÿһ����������Ϊ����IJ�ṹconcat�Ȳ���Ҫ�õ�# dt: ��profile������������ʱʹ��y, dt = [], []for m in self.model:# ǰ������ÿһ��ṹ m.i=index m.f=from m.type=���� m.np=number of params# if not from previous layer m.f=��ǰ�������������һ������ s��m.f����-1if m.f != -1:# ������Ҫ��4��concat������1��Detect����# concat������m.f=[-1, 6] x��������Ԫ��,һ������һ������,��һ����index=6�IJ����� ���͵�x=m(x)��concat����# Detect����m.f=[17, 20, 23] x������Ԫ��,�ֱ��ŵ�17���20���23������ ���͵�x=m(x)��Detect��forwardx = y[m.f] if isinstance(m.f, int) else [x if j == -1 else y[j] for j in m.f] # from earlier layers# ��ӡ��־��Ϣ FLOPs time��if profile:o = thop.profile(m, inputs=(x,), verbose=False)[0] / 1E9 * 2 if thop else 0 # FLOPst = time_synchronized()for _ in range(10):_ = m(x)dt.append((time_synchronized() - t) * 100)if m == self.model[0]:logger.info(f"{

'time (ms)':>10s} {

'GFLOPs':>10s} {

'params':>10s} {

'module'}")logger.info(f'{

dt[-1]:10.2f} {

o:10.2f} {

m.np:10.0f} {

m.type}')x = m(x) # run�������� # �����self.save��ÿһ����������Ϊ������Ҫ������concat�Ȳ���Ҫ�õ� ����self.save��������ΪNoney.append(x if m.i in self.save else None)# �������ӻ� �����Լ��Ķ���Ҫ�IJ���������п��ӻ�if feature_vis and m.type == 'models.common.SPP':feature_visualization(x, m.type, m.i)# ��ӡ��־��Ϣ ǰ������ʱ��if profile:logger.info('%.1fms total' % sum(dt))return xdef _initialize_biases(self, cf=None):"""���������__init__������initialize biases into Detect(), cf is class frequencyhttps://arxiv.org/abs/1708.02002 section 3.3"""# cf = torch.bincount(torch.tensor(np.concatenate(dataset.labels, 0)[:, 0]).long(), minlength=nc) + 1.m = self.model[-1] # Detect() modulefor mi, s in zip(m.m, m.stride): # fromb = mi.bias.view(m.na, -1) # conv.bias(255) to (3,85)b.data[:, 4] += math.log(8 / (640 / s) ** 2) # obj (8 objects per 640 image)b.data[:, 5:] += math.log(0.6 / (m.nc - 0.99)) if cf is None else torch.log(cf / cf.sum()) # clsmi.bias = torch.nn.Parameter(b.view(-1), requires_grad=True)def info(self, verbose=False, img_size=640): # print model information"""���������__init__�����ϵ���torch_utils.py��model_info������ӡģ����Ϣ"""model_info(self, verbose, img_size)def _descale_pred(self, p, flips, scale, img_size):"""���������__init__�����Ͻ���������ָ���ԭͼͼƬ�ߴ� Test Time Augmentation(TTA)���õ�de-scale predictions following augmented inference (inverse operation):params p: �������:params flips::params scale::params img_size:"""# ��ͬ�ķ�ʽǰ������ʹ�ù�ʽ��ͬ ����ɿ�Detect����if self.inplace: # Ĭ��ִ�� ��ʹ��AWS Inferentiap[..., :4] /= scale # de-scaleif flips == 2:p[..., 1] = img_size[0] - p[..., 1] # de-flip udelif flips == 3:p[..., 0] = img_size[1] - p[..., 0] # de-flip lrelse:x, y, wh = p[..., 0:1] / scale, p[..., 1:2] / scale, p[..., 2:4] / scale # de-scaleif flips == 2:y = img_size[0] - y # de-flip udelif flips == 3:x = img_size[1] - x # de-flip lrp = torch.cat((x, y, wh, p[..., 4:]), -1)return pdef _print_biases(self):"""��ӡģ�������Detect���ƫ��bias��Ϣ(Ҳ������ѡ��Щ��bias��Ϣ)"""m = self.model[-1] # Detect() modulefor mi in m.m: # fromb = mi.bias.detach().view(m.na, -1).T # conv.bias(255) to (3,85)logger.info(('%6g Conv2d.bias:' + '%10.3g' * 6) % (mi.weight.shape[1], *b[:5].mean(1).tolist(), b[5:].mean()))def _print_weights(self):"""��ӡģ����Bottleneck���Ȩ�ز���weights��Ϣ(Ҳ������ѡ��Щ��weights��Ϣ)"""for m in self.model.modules():if type(m) is Bottleneck:logger.info('%10.3g' % (m.w.detach().sigmoid() * 2)) # shortcut weightsdef fuse(self):"""����detect.py��val.pyfuse model Conv2d() + BatchNorm2d() layers����torch_utils.py�е�fuse_conv_and_bn������common.py��Convģ���fuseforward����"""logger.info('Fusing layers... ') # ��־# ����ÿһ��ṹfor m in self.model.modules():# �����ǰ���Ǿ�����Conv����bn�ṹ, ��ô�͵���fuse_conv_and_bn������conv��bn�����ں�, ��������if type(m) is Conv and hasattr(m, 'bn'):m.conv = fuse_conv_and_bn(m.conv, m.bn) # �ں� update convdelattr(m, 'bn') # �Ƴ�bn remove batchnormm.forward = m.fuseforward # ����ǰ�� update forward (�������ù�, ��Ϊ��������ֻ����������)self.info() # ��ӡconv+bn�ںϺ��ģ����Ϣreturn selfdef nms(self, mode=True):"""add or remove NMS module������ѡ�Ƿ���չmodel ����ģ��nms���� ֱ�ӵ���common.py�е�NMSģ��һ�����ò����� ǰ����������ֱ�ӵ���non_max_suppression��������"""present = type(self.model[-1]) is NMS # last layer is NMSif mode and not present:logger.info('Adding NMS... ')m = NMS() # modulem.f = -1 # fromm.i = self.model[-1].i + 1 # indexself.model.add_module(name='%s' % m.i, module=m) # add nms module to modelself.eval() # nms ����ģ����֤ģʽelif not mode and present:logger.info('Removing NMS... ')self.model = self.model[:-1] # remove nms from modelreturn selfdef autoshape(self):"""add AutoShape module ֱ�ӵ���common.py�е�AutoShapeģ�� Ҳ��һ����չģ���ܵ�ģ��"""logger.info('Adding AutoShape... ')# wrap model ��չģ���� ��ʱģ�Ͱ���ǰ������������������ģ��(Ԥ���� + ���� + nms)m = AutoShape(self)copy_attr(m, self, include=('yaml', 'nc', 'hyp', 'names', 'stride'), exclude=()) # copy attributesreturn m

�ܽ�

\qquad����ļ��ҵĽ��Ͳ����࣬��ҪҪ���͵Ķ�д��ע�����ˣ��Ҿ�����д�Ļ���ͦ���ģ�����в�����������������۰ɣ�

�C 2021.08.23 2021.08.23