���룺https://github.com/MONI-JUAN/Tensorflow_Study/tree/master/ch09-pix2pixģ�����Զ���ɫ����

Ŀ¼

-

- һ������

-

- 1.GANȱ��

- 2.cGAN

- 3.GAN �� cGAN�Ա�

- 4.Ӧ��

- 5.pix2pix ģ��

- ����pix2pix

-

- 1.�������ݼ�

- 2.�鿴���ݼ�

- 3.ѵ��ģ��

- 4.�鿴ѵ�����

- 5.����ģ��

- 6.�������ݼ�

-

- a)Ϊʳ��ͼƬ��ɫ

- b)Ϊ����ͼƬ��ɫ

һ������

1.GANȱ��

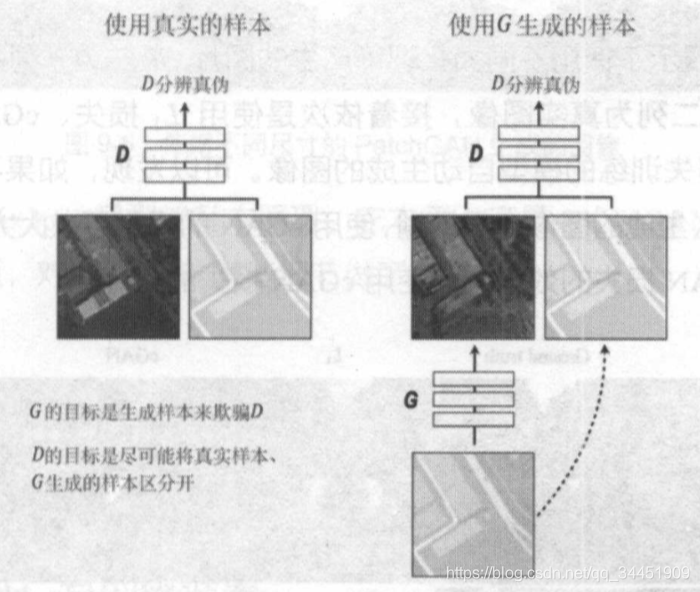

ʹ�� GAN ���Զ����������ලѧϰ��Ȼ������ȫ�µ�����������Ȼ�������µ�������ȴ��ȷ�п��������������͡�

��ʹ�� GAN ���� MNIST ���֣���Ȼ�����������֣������ɵĽ������� �ģ���Ϊ�Ǹ�������������������ͼƬ��û�ٰ취����ģ�����ɵľ������֡�

2.cGAN

cGAN�� Conditional Generative Adversarial Networks���������Կ��������磬��Ϊ���������б��������������һ������y���������ʵ����ϣ�����ɵı�ǩ��������G ����Ҫ���ɺ�����yƥ����������б�������Ҫ�б�ͼ���Ƿ���ʵ����Ҫ�б�ͼ�������y �Ƿ�ƥ�䡣

3.GAN �� cGAN�Ա�

-

GAN

-

������ G������Ϊһ������ z�����һ��ͼ�� G(z)

-

�б��� D������Ϊһ��ͼ�� x�������ͼ��Ϊ��ʵ�ĸ���D(x)

-

�Ż�Ŀ�꣺

V(D,G)=Ex?Pdata [ln?D(x)]+Ez?pz(z)[ln?(1?D(G(z)))]V(D, G)=E_{x \sim P_{\text {data }}}[\ln D(x)]+E_{z \sim p_{z}(z)}[\ln (1-D(G(z)))] V(D,G)=Ex?Pdata ??[lnD(x)]+Ez?pz?(z)?[ln(1?D(G(z)))]

-

-

cGAN

-

������ G������Ϊһ������ z�� һ������y�����һ��ͼ�� G(z|y)

-

�б��� D������Ϊһ��ͼ�� x�� һ������y�������ͼ���ڸ������µĸ���D(x|y)

-

�Ż�Ŀ�꣺

V(D,G)=Ex?Pdata [ln?D(x�Oy)]+Ez?pz(z)[ln?(1?D(G(z�Oy)))]V(D, G)=E_{x \sim P_{\text {data }}}[\ln D(x|y)]+E_{z \sim p_{z}(z)}[\ln (1-D(G(z|y)))] V(D,G)=Ex?Pdata ??[lnD(x�Oy)]+Ez?pz?(z)?[ln(1?D(G(z�Oy)))]

-

-

�� MNIST ����cGAN

- ������ G������Ϊһ������ z�� һ�����ֱ�ǩy��0 ~ 9�������һ�����ϱ�ǩ��ͼ�� G(z|y)

- �б��� D������Ϊһ��ͼ�� x�� һ�����ֱ�ǩy�������ͼ������ַ��ϵĸ���D(x|y)

- ��ѵ����ɺ��� G ����ij�����ֱ�ǩ���������������ɶ�Ӧ���ֵ�ͼ��

4.Ӧ��

- ���־��ı�עͼ���Ϊ��ʵ��Ƭ��

- ��������עͼ��ת��Ϊ��Ƭ��

- ������ͼ��ת��Ϊ������

- �������ͼƬת��Ϊҹ����ͼƬ��

- ����Ե������ת��Ϊ��ʵ���塣

5.pix2pix ģ��

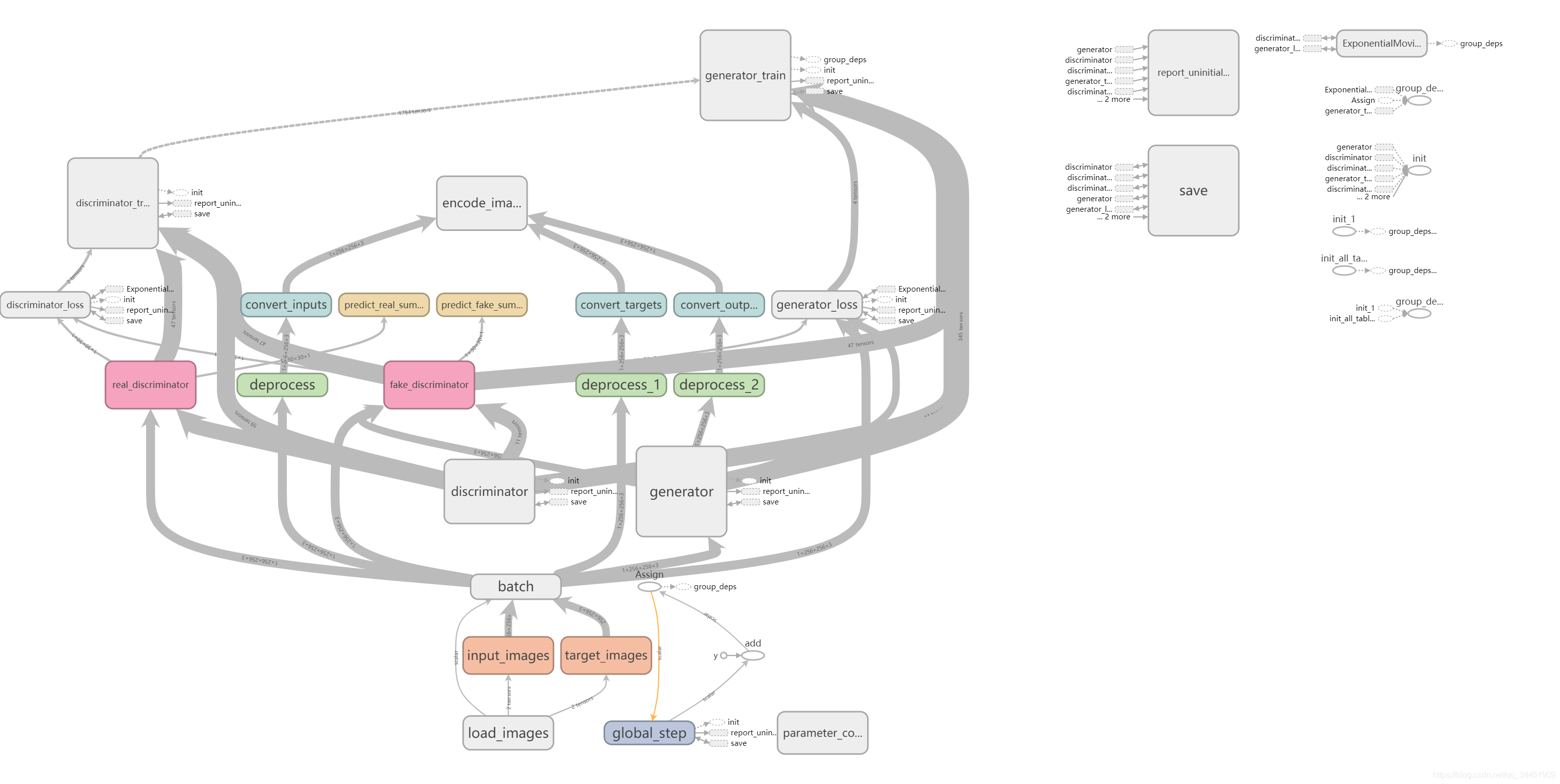

pix2pix �� cGAN �Ľṹ���ƣ�ͬ������������ G���б��� D ����������ɡ� ��Ҫ�� Y���͵�ͼ��ת��Ϊ X���͵�ͼ�� G�� D ������ֱ�Ϊ ��

- G ��������һ�� Y ��ͼ�� y �����Ϊ����ͼ�� G(y����

- D ������Ϊһ�� X ��ͼ��x��һ�� Y ��ͼ��y��D ��Ҫ�ж� x ͼ���Ƿ���������y��Ӧ��ͼ�����һ�����ʡ�

����pix2pix

1.�������ݼ�

�������ݼ�facades.rar

�ýű���

python tools/download-dataset.py facades

���߰ٶ������ӣ�https://pan.baidu.com/s/1LhYMOCiHRr_qRryG4FcB6A

��ȡ�룺8x8b

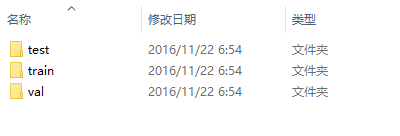

2.�鿴���ݼ�

��ɺ� facades �ļ������������ļ��У��ֱ��� test��train��val��

����һ�ţ�

ͼƬ����߳�Ϊ A�࣬�ұ�Ϊ B�ࡣѵ��ʱ����ָ���ǡ�A�෭��ΪB�ࡿ���ǡ�B�෭��ΪA�ࡿ��

�� Facades ���ݼ��У�ϣ�������ܴ�ͼ��ı�ע������������ʵ�Ľ���ͼ����ˣ�����ͼ�������˳��Ӧ��ָ���� B ��ͼ��ת���� A ��ͼ��

-

cGAN , ��ԭʼ GAN ʹ�������������������ͬ�� cGAN ���Ը���ָ����ǩ������ ����

-

pix2pix ģ�ͣ����Կ����� cGAN ��һ��������ʽ��

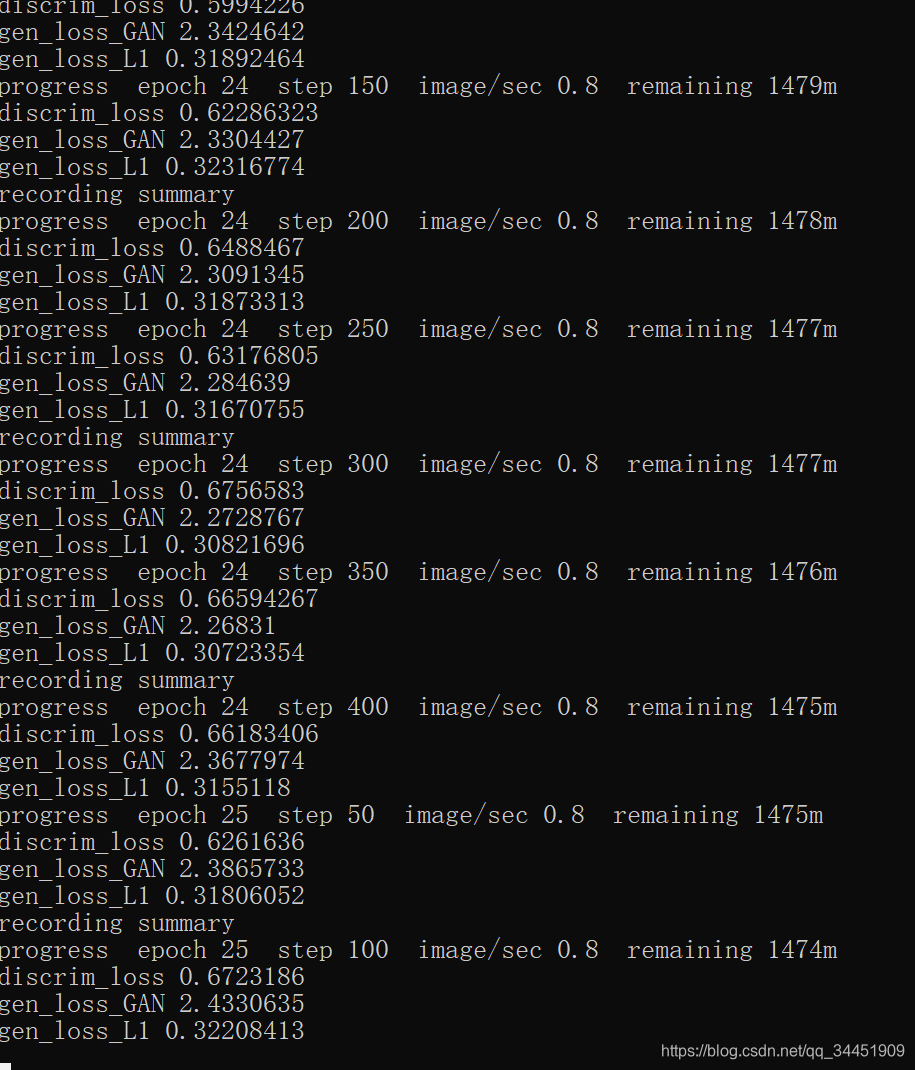

3.ѵ��ģ��

python pix2pix.py \--mode train \ # ѵ��--output_dir facades_train \ # ���·��--max_epochs 200 \ # ���epoch��--input_dir facades/train \ # ���ݼ�·��--which_direction BtoA # ѧϰ��B��ͼ��ת��ΪA��

python pix2pix.py --mode train --output_dir facades_train --max_epochs 200 --input_dir facades/train --which_direction BtoA

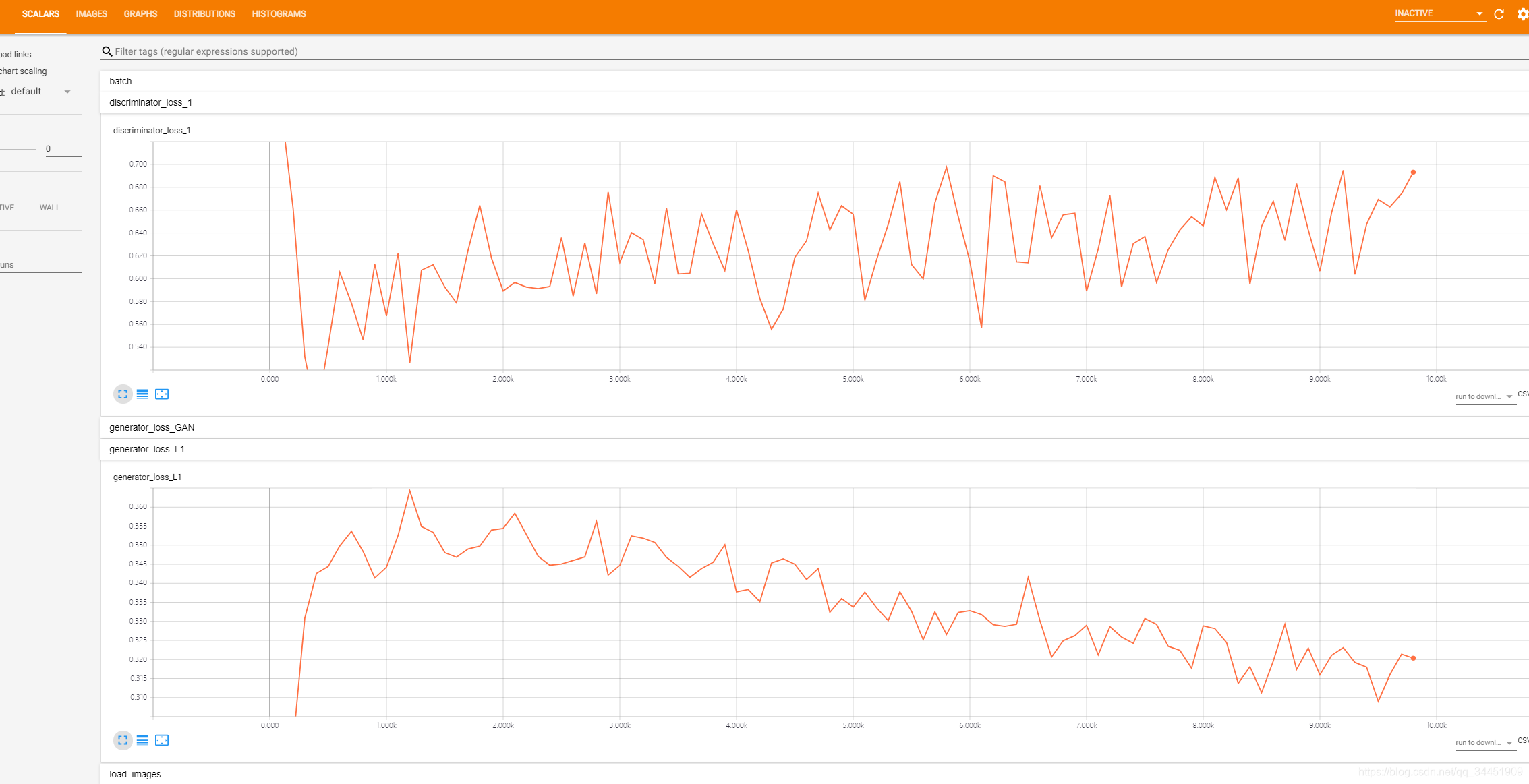

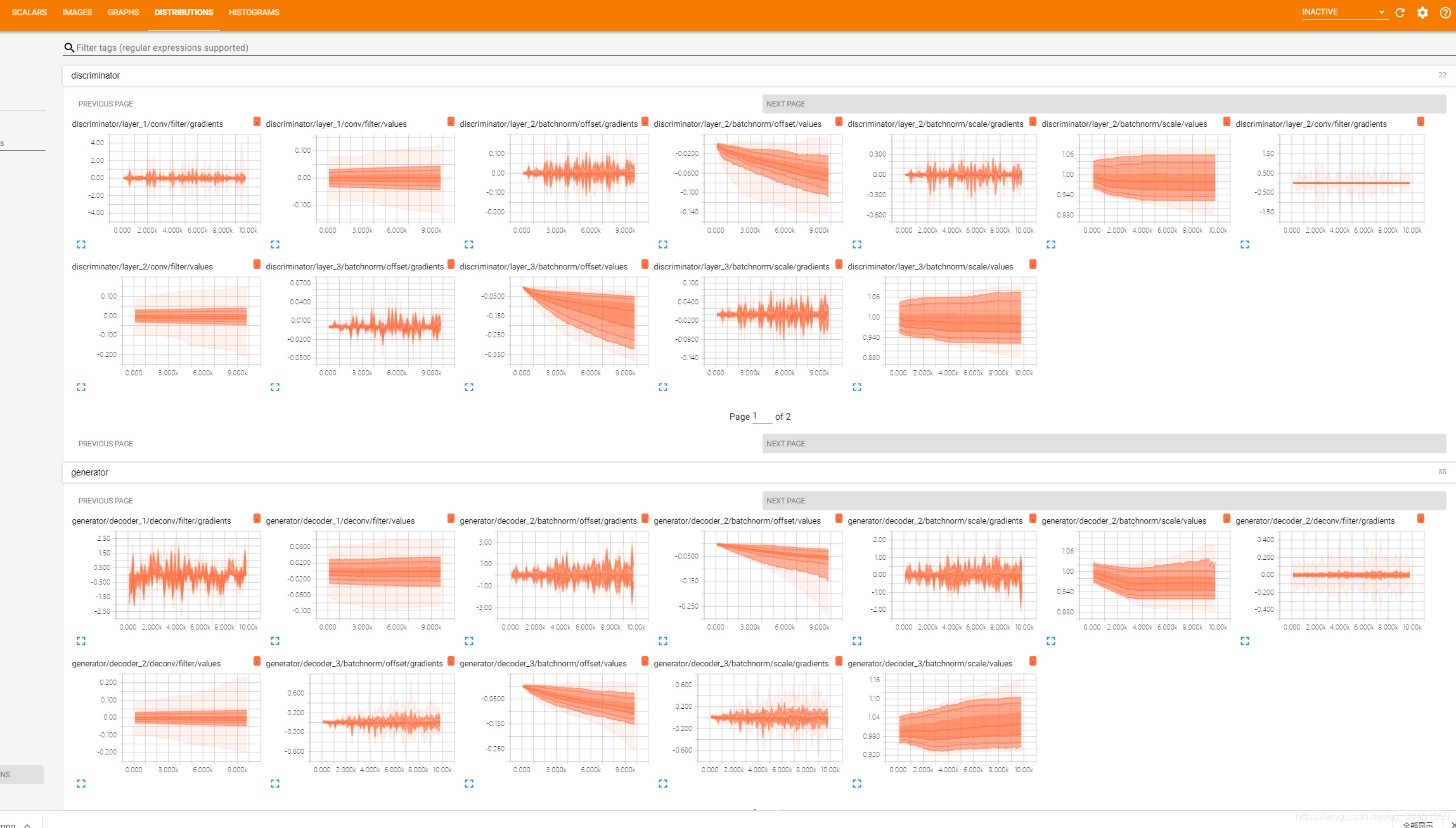

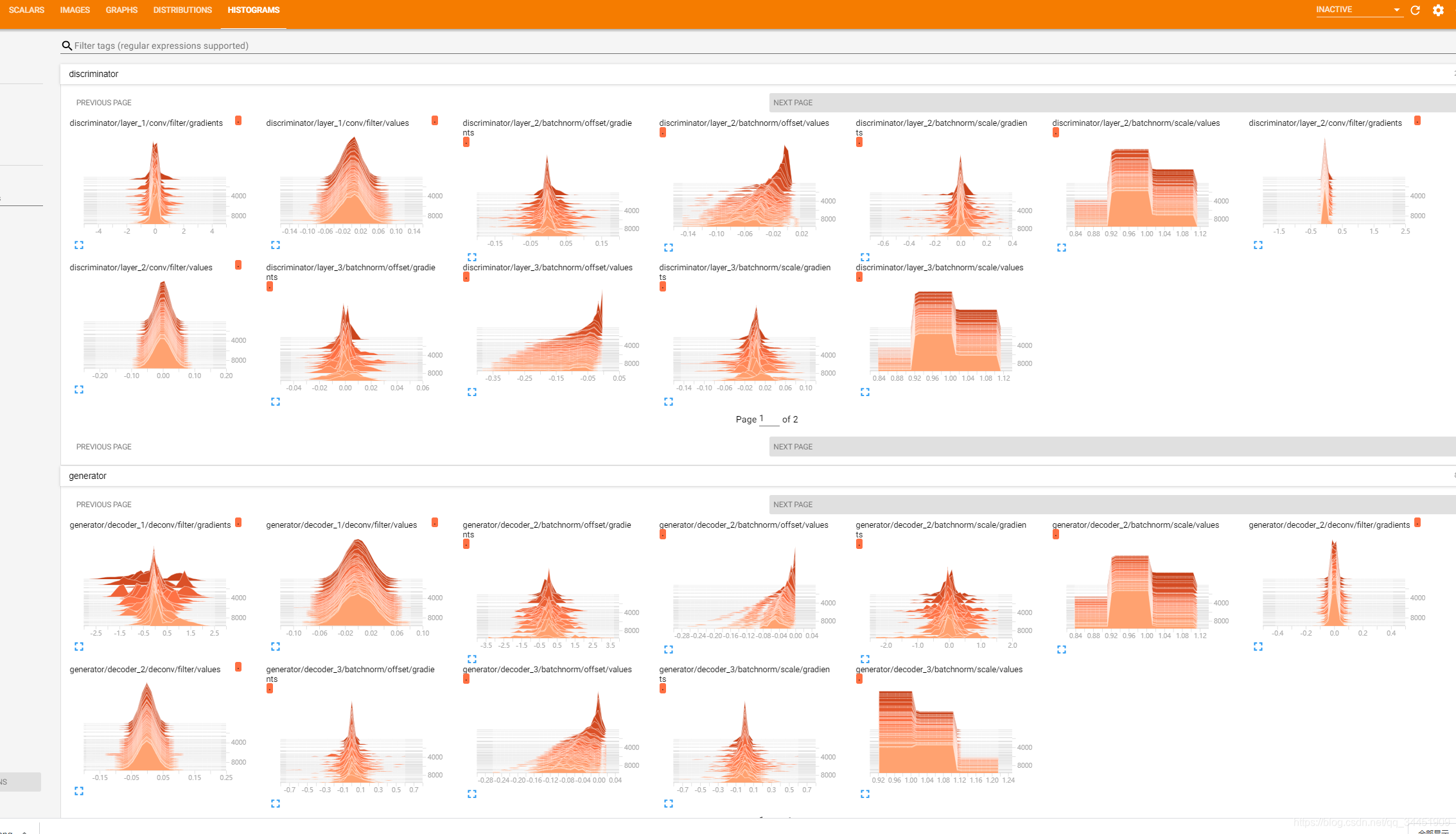

4.�鿴ѵ�����

tensorboard --logdir facades_train

5.����ģ��

python pix2pix.py \--mode test \ # ����--output_dir facades_test \ # ���·��--input_dir facades/val \ # ����·��--checkpoint facades_train # ����ģ��

python pix2pix.py --mode test --output_dir facades_test --input_dir facades/val --checkpoint facades_train

ѵ�������ĸ�Сʱ�Ľ�������պϡ�

6.�������ݼ�

�ٶ��ƿ������������ݼ���Ҳ����ʳ��Ͷ�����

�ٶ������ӣ�https://pan.baidu.com/s/1LhYMOCiHRr_qRryG4FcB6A

��ȡ�룺8x8b

��������м��������ýű����أ�

python tools/download-dataset.py facades

python tools/download-dataset.py cityscapes

python tools/download-dataset.py maps

python tools/download-dataset.py edges2shoes

python tools/download-dataset.py edges2handbags

ÿ��ѵ��ʱ��̫���ˣ���������û���ܣ��пյĿ�������

a)Ϊʳ��ͼƬ��ɫ

��chapter_9_data/���ṩ��food_resized.zip �ļ���ѹ��Ŀ¼~/datasets/colorlization/�£������γɵ��ļ� �нṹӦ���ǣ�

~/datasetscolorlization/food_resized/train/val/

ѵ�����

python pix2pix.py \

--mode train \

--output_dir colorlization_food \

--max_epochs 70 \

--input_dir ~/datasets/colorlization/food_resized/train \

--lab_colorization

�������

python pix2pix.py \--mode test \--output_dir colorlization_food_test \--input_dir ~/datasets/colorlization/food_resized/val \--checkpoint colorlization_food

�����colorlization_food_test�ļ����С�

b)Ϊ����ͼƬ��ɫ

��chapter_9_data/���ṩ�Ķ���ͼ�����ݼ�anime_reized.zip ��ѹ��~/datasets/colorlization/Ŀ¼�£��γɵ��ļ��нṹΪ��

~/datasetscolorlization/anime_resized/train/val/

ѵ�����

python pix2pix.py \--mode train \--output_dir colorlization_anime \--max_epochs 5 \--input_dir ~/datasets/colorlization/anime_resized/train \--lab_colorization

�������

python pix2pix.py \--mode test \--output_dir colorlization_anime_test \--input_dir ~/datasets/colorlization/anime_resized/val \--checkpoint colorlization_anime

�����colorlization_anime_test�ļ����С�