推荐中引入知识图谱的优点

知识图谱作为一种异构网络,节点表示实体,诸如物品,产品,以及他们的属性,特征;边对应为实体之间的关系,知识图谱可以获取一系列实体之间的关系和结构信息。因此,知识图谱提供了不同物品之间各种各样的关系和可以捕获物品间的语义关系。

提出背景

目前一些工作已经利用GNN架构来构建推荐模型,但是这些方法大多数是利用同构的用户-物品二部图,因此,如何扩展GNN到异构知识图谱称为待解决问题。本文将GNN扩展到知识图谱中,同时捕获物品之间的语义关系和用户个性化偏好

本文提出的方法

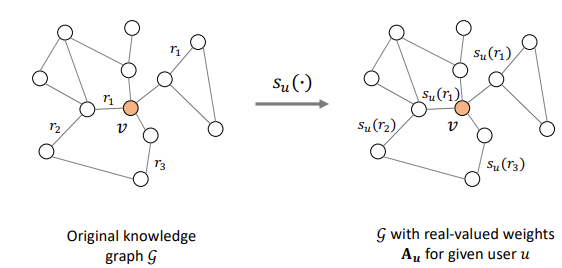

本文使用的方法是从特定用户出发的,计算特定用户对每一个物品的嵌入表示,由于用户对不同的关系重视程度不同,因此可以根据用户对关系的评分将无权知识图谱转换为带权特定用户图,然后使用GNN计算特定用户下,每一个物品的嵌入表示。我们的方法和传统GNN之间的一个显著区别是,图中的边缘权重不是作为输入给出的。我们使用用户特定的关系评分函数来设置它们,该函数以监督的方式进行训练。然而,边缘权重的灵活性使得学习过程容易过度拟合,因为关系评分函数的唯一监督信号来源是来自用户-项目交互(一般来说是稀疏的)。为了弥补这个问题,我们开发了一种在学习过程中对边缘权重进行正则化的技术,从而实现更好的泛化。我们开发了一种基于标签平滑性的方法,它假设KG中相邻的实体很可能具有相似的用户相关性标签/分数。在我们的上下文中,这个假设意味着用户倾向于对KG中邻近的项目有相似的偏好。我们证明标签平滑度正则化等同于标签传播,我们为标签传播设计了一个留一的损失函数,为学习边缘评分函数提供额外的监督信号。我们证明知识感知图神经网络和标签平滑度正则化可以统一在同一个框架下,标签平滑度可以看作是知识感知图神经网络上正则化的自然选择。

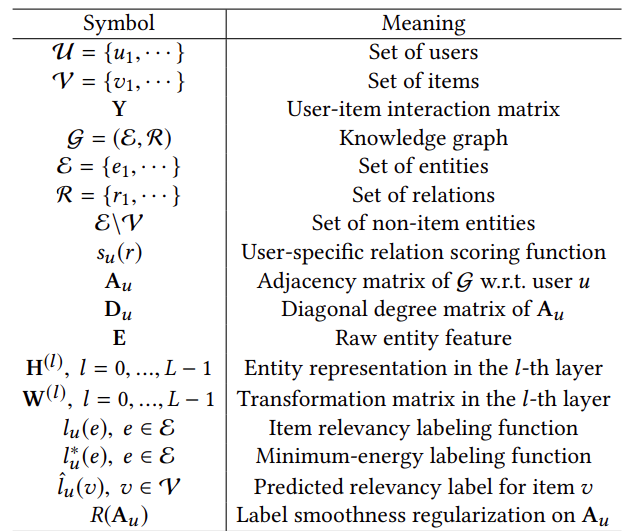

数学定义

基本架构

Preliminaries: Knowledge-aware Graph Neural Networks

- step1:知识图谱转化为特定用户的邻接矩阵

特定用户对关系的评分,表示关系对用户的重要性su(r)=g(u,r)s_{u}(r)=g(\mathbf{u}, \mathbf{r}) su?(r)=g(u,r)

对于指定用户uuu来说,具有一个关系评分邻接矩阵

- step2:层级别的前向传播

Hl+1=σ(Du?1/2AuDu?1/2HlWl),l=0,1,?,L?1\mathbf{H}_{l+1}=\sigma\left(\mathbf{D}_{u}^{-1 / 2} \mathbf{A}_{u} \mathbf{D}_{u}^{-1 / 2} \mathbf{H}_{l} \mathbf{W}_{l}\right), l=0,1, \cdots, L-1 Hl+1?=σ(Du?1/2?Au?Du?1/2?Hl?Wl?),l=0,1,?,L?1

其中H0=EH_0=\bold EH0?=E,Hl\bold H_lHl?是第lll层的实体集合的表示。

单个GNN层通过自身及其在KG中的直接邻居来计算实体的表示。

Label Smoothness Regularization

本文的方法和传统的GNN一个很大的区别是:在传统的GNN中,输入图中边的权重是固定的,但是在我们的模型中,边的权重Du?1/2AuDu?1/2\mathbf{D}_{u}^{-1 / 2} \mathbf{A}_{u} \mathbf{D}_{u}^{-1 / 2}Du?1/2?Au?Du?1/2?是可学习的,同样需要可监督学习。虽然增强了模型的拟合能力,但这将不可避免地使优化过程容易出现过拟合,因为监督信号的唯一来源是来自GNN层外的用户-项目交互。此外,边缘权重在图上的表示学习中确实起到了至关重要的作用,因此,需要对边缘权重进行更多的正则化,以协助实体表征的学习,并帮助更有效地泛化到未观察到的交互。

联合损失函数

min?W,AL=min?W,A∑u,vJ(yuv,y^uv)+λR(A)+γ∥F∥22\min _{\mathbf{W}, \mathbf{A}} \mathcal{L}=\min _{\mathbf{W}, \mathbf{A}} \sum_{u, v} J\left(y_{u v}, \hat{y}_{u v}\right)+\lambda R(\mathbf{A})+\gamma\|\mathcal{F}\|_{2}^{2}W,Amin?L=W,Amin?u,v∑?J(yuv?,y^?uv?)+λR(A)+γ∥F∥22?

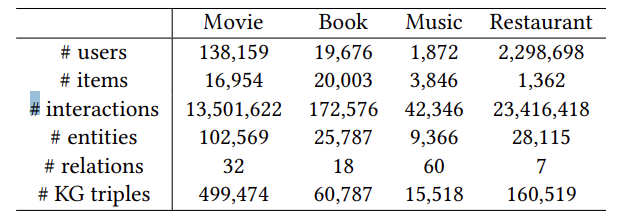

数据集

- MovieLens-20M

- Book-Crossing

- Last.FM

- Dianping-Food

https://www.ofweek.com/ai/2020-03/ART-201700-8300-30431204.html