����Ŀ¼

- 1.ǰ��

- 2.����Ԥ����

-

-

- 2.1���ز鿴����ת����Ľ��

-

- 3.�������ݼ�

- 4.���ݼ��ָ�

- 5.ģ�ͼܹ�

-

-

- 5.1ģ�ͳ�ʼ��

- 5.2ǰ������

-

- 6.ģ��ѵ��

-

-

- 6.1ѵ��һ��epoch

- 6.2ѵ������epoch

- 6.3evaluate����

-

- 7.����ѵ������

1.ǰ��

- ������Ҫ��������ʵ��Ĵ��룬������Ҫ���̺ʹ��뺬�壬������ע������ѡ���ģ�͵�ѡ��

- �������ܻ������

model��ԭ�� - ��������⣬��ӭ���ۻ�˽������

- ���������̳��ִ����뼰ʱָ����лл

2.����Ԥ����

- ԭʼ��ע���Ծ����е�ÿ���ֱ�ע��һ����ǩ�����Լؿ�����ֱ�Ӷ�ÿ���ַ��ࣨ��Ҫ�ں���������Ϣ������˿���ʹ��һ�������������������������Ǹ��ֵı�ǩ

- ���ϱ�ע����һ���������ֱ�ע��ͬ�ı�ǩ����NER�����У�ʵ����һ����������ɣ��������������ϱ�ע������

���������ϱ�ע�У����ڴ����ǩ֮����ܻ����������ϵ����һ�������ͨ����ǩת���ķ�ʽ�������ϱ�עת����ԭʼ��ע�����

��������ʹ�õ���BIOS��ע

| ��ǩ | ���� |

|---|---|

| B-X | �����Ǵ�Ƭ�� X ����ʼ�� |

| I-X | �����Ǵ�Ƭ�� X ��ʼ��֮����� |

| S-X | ���ֵ������Ϊ X ��ǩ |

| O | ���ֲ��������ȶ�����κδ�Ƭ������ |

��process.py�У����ǽ�.json�ļ��е����ͱ�ǩ������BIOS��ʽ������ת������.npz�ļ�����Ҫ�������¡���������д��ע���У���������.json��

text = json_line['text']

words = list(text) # �Զ������Ӱ��ַ��ֿ�

# ���û��label����None

label_entities = json_line.get('label', None) # �������������, �����Ӧ label ֮�������

labels = ['O'] * len(words) # [len(words) �� 'O'] ����ʼ��Ϊ `O`if label_entities is not None:for key, value in label_entities.items(): # key ��Ӧ name �� company, value ��Ӧ����洢����for sub_name, sub_index in value.items(): # sub_name ��Ӧ Ҷ�Ϲ��, sub_value ��Ӧ���������for start_index, end_index in sub_index: # ��Ӧ�б��е�������,�DZ�ǩ��ʼ�ͽ�����λ��assert ''.join(words[start_index:end_index + 1]) == sub_nameif start_index == end_index: # ��������Ϊ����labels[start_index] = 'S-' + keyelse:labels[start_index] = 'B-' + key # ��ͷlabels[start_index + 1:end_index + 1] = ['I-' + key] * (len(sub_name) - 1) # �м����

-

�ַ���ת

list��֤- �������Ҫ��һ���ǣ�������ַ�����ת�ɵ��ַ��ˣ�����ʹ�� tokenize ��ʱ��ῴ��Ϊʲô

a = "���,����nsy,������" print(list(a)) >>['��', '��', ',', '��', '��', 'n', 's', 'y', ',', '��', '��', '��']

.json�ļ��У����ݴ洢�ṹ������ʾ

{

"text": "����������ҵ�Ŵ���Ҷ�Ϲ�ʿ�����һ���Ƕȶ�����ż������˽����Ҷ�Ϲ���Ϊ����Ŀǰ������ҵ���ж��ԣ�","label": {

"name": {

"Ҷ�Ϲ�": [[9, 11],[32, 34]]},"company": {

"��������": [[0, 3]]}}

}

2.1���ز鿴����ת����Ľ��

-

code

import numpy as np a = np.load(r'D:\2022 spring\nlp\exp4\code\BERT-LSTM-CRF\data\clue\test.npz', allow_pickle=True) index = 0 words = a['words'] labels = a['labels'] print(words[0]) print(labels[0]) -

���

['��', 'С', '��', '��', 'Ϊ', '��', '��', '��', '��', '��', '��', '��', '��', '��', '��', '̨', '��', '��', '��', '��', 'ģ', 'ʽ', '��', '��', 'ͨ', '��', '��', '��', 'Ȧ', '��', '��', '��', 'Ȧ', '��', '��', '��', '��', 'ѡ', '��', '��', '��', '��'] ['B-name', 'I-name', 'I-name', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'B-address', 'I-address', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O', 'O']

3.�������ݼ�

���ǹ����Լ������ݼ�Dataset�ࡣ������Ҫ����Ϊ

self.tokenizer = BertTokenizer.from_pretrained(config.bert_model, do_lower_case=True)

self.label2id = config.label2id

self.id2label = {

_id: _label for _label, _id in list(config.label2id.items())}

self.dataset = self.preprocess(words, labels)

self.word_pad_idx = word_pad_idx # ���ʼ�����õ�

self.label_pad_idx = label_pad_idx # ���ʼ�����õ�

self.device = config.device

-

��Ϊ���Ǽ��ص�������

.npz�ļ��еģ����ݣ�����label���Ǵ����б��еĵ����ַ������Dz����зִʹ����ˡ����������tokenizer������Ҫ�ǽ���д��ĸת��ΪСд��ĸ -

һ���Ƚ��������������

self.dataset���������������浽����ʲô���ݡ�preprocess�������¡�������Ҫ����Ϊ- ��ÿ�仰ǰ���һ����ͷ

CLS - ��ԭʼ�ַ�/�ֶ�ת����

id�����洢��label���ֵĿ�ʼλ�õ����� - ��

labelת�ɳ�id - ע�⣺������

token�ij��ȶ���1��������.npz�е�������Ϊ���������

def preprocess(self, origin_sentences, origin_labels): # ������� .npz ���������"""Maps tokens and tags to their indices and stores them in the dict data.examples: word:['[CLS]', '��', '��', '��', '��', '��', 'ҵ', '��', '��', '��']sentence:([101, 3851, 1555, 7213, 6121, 821, 689, 928, 6587, 6956],array([ 1, 2, 3, 4, 5, 6, 7, 8, 9, 10]))label:[3, 13, 13, 13, 0, 0, 0, 0, 0]"""data = []sentences = []labels = []for line in origin_sentences: # ����ÿһ�仰,����Ϊ listwords = []word_lens = []for token in line: # һ�仰�е�ÿ����words.append(self.tokenizer.tokenize(token)) # tokennize���:'��'->['��']word_lens.append(len(token)) # len(token) ȫ�� 1# ��ͷ����[CLS]words = ['[CLS]'] + [item for token in words for item in token] # token ���ַ��б�, item �� token �е���, Ҳ���ǵ�����token_start_idxs = 1 + np.cumsum([0] + word_lens[:-1]) # ���� `[CLS]` ֮�������, д��һ���б�sentences.append((self.tokenizer.convert_tokens_to_ids(words), token_start_idxs)) # �� token �� id �� index һ����� setencesfor tag in origin_labels: # tag ��ÿһ�е� origin_sentences �е��ֶ�Ӧ�� labellabel_id = [self.label2id.get(t) for t in tag] # ÿ���ֵ� label -> idlabels.append(label_id)for sentence, label in zip(sentences, labels):data.append((sentence, label))return data # ��Ϊ self.dataset-

�Ƚ�������IJ���

for token in line:words.append(self.tokenizer.tokenize(token))word_lens.append(len(token)) words = ['[CLS]'] + [item for token in words for item in token] token_start_idxs = 1 + np.cumsum([0] + word_lens[:-1])-

�������������˵��

tokenize��������->['��']-

tokenize��ʵ�зִʵ����ã�����import torch import numpy as np from transformers import BertTokenizertokenizer = BertTokenizer.from_pretrained('pretrained_bert_models/bert-base-chinese/', do_lower_case=True) print(tokenizer.tokenize("unwanted")) print(tokenizer.tokenize("===+")) >>['u', '##n', '##wan', '##ted'] >>['=', '=', '=', '+'] -

������������ܣ�

len(token)�� ��ʵ������ʼλ�þͶԲ����ˣ�����unwanted����tokenize֮���ṩ�ĸ����֣���������ȴҪ + 8 -

������ַ�ȫ�ǵ����ģ���������������ֻ�д�д -> Сд������

-

-

forѭ��֮�õ�words = [['��'], ['��'], ['��'], ['��'], ['��'], ['ҵ'], ['��'], ['��'], ['��']]����д��Сд������û�����֡�word_lens=[1,1,1,1,1,1,1,1,1] -

��һ��

words->['[CLS]', '��', '��', '��', '��', '��', 'ҵ', '��', '��', '��'] -

word_lensȥ�����һ����ǰ������һ��0��Ȼ��ǰ����� + 1���õ�[ 1, 2, 3, 4, 5, 6, 7, 8, 9]������Ϊ���������ִ��ˣ�����û���⣬�����Ѿ����Թ������Ҹо�ֱ�Ӷ�word_lensǰ����;���

-

- ��ÿ�仰ǰ���һ����ͷ

-

�ò��ֻ���һ����Ҫ������

collate_fn(self, batch)����Ҫ����Ϊ��- ��ÿ��

batch��data���䵽ͬһ���ȣ�batch�����data�ij��ȣ�- ���ҵ����ij���

- ��ʼ��һ�������Ӹ���, �����ӳ��ȣ�, ��ʼ��ֵΪ

0 - ����Ӧ��ֵ�ŵ���Ӧ��������

- ��ÿ��

batch��label���䵽ͳһ���ȣ�batch�����label�ij��ȣ�- ���ҵ����ij���

- ��ʼ��һ�������Ӹ���, ���

label���ȣ� - ����Ӧ��ֵ�ŵ���Ӧ��������

- ��

batch_data, batch_label_starts, batch_labelsת��Ϊtensor���ƶ���GPU�ϣ�Ȼ��

- ��ÿ��

4.���ݼ��ָ�

���ǰ���9:1�ı�������ѵ�����ݷָ��ѵ��������֤����������run.py�С�

# �������֤��

word_train, word_dev, label_train, label_dev = load_dev('train')

����load_dev()��������

def dev_split(dataset_dir): # �ֳ�ѵ��������֤�� ����: BERT-LSTM-CRF/data/clue/train.npz"""split dev set"""data = np.load(dataset_dir, allow_pickle=True)words = data["words"]labels = data["labels"]x_train, x_dev, y_train, y_dev = train_test_split(words, labels, test_size=config.dev_split_size, random_state=0) # ���Լ���СΪ 0.1return x_train, x_dev, y_train, y_dev

5.ģ�ͼܹ�

5.1ģ�ͳ�ʼ��

- ���ǵ�ģ�ͼ̳���һ��Ԥѵ��ģ��

BertPreTrainedModel - ��Ҫ���ԣ�

- һ��

bertģ�ͣ�Transformer�Ķѵ���bert��ΪEncoding��ʹ�ã����������ݽ��б��룩 Bert���_��������?�IJ���-CSDN���� dropout��- һ�������

bilstm(˫��lstm)����� - һ�����Է�����

- һ��

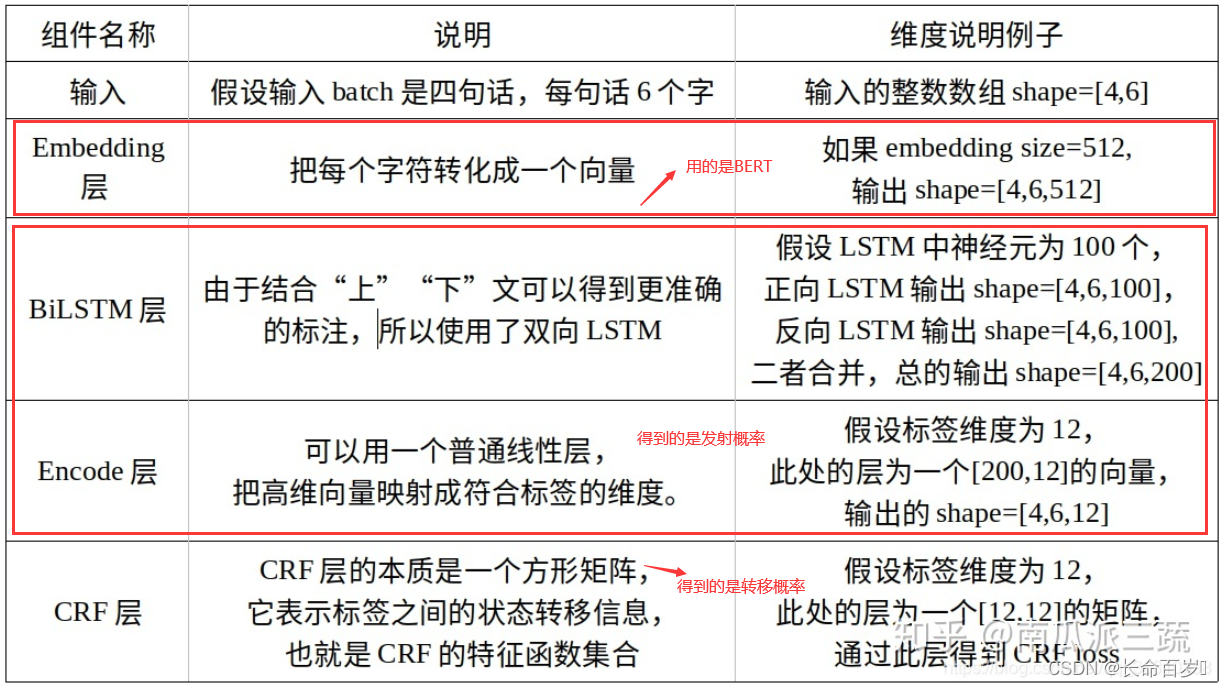

crfģ�� bilstm-CRFģ�ͽṹ������ʾ�����������и��������

- һ��

class BertNER(BertPreTrainedModel):def __init__(self, config):super(BertNER, self).__init__(config)self.num_labels = config.num_labels # label ����Ŀself.bert = BertModel(config) # ���� bert ģ��self.dropout = nn.Dropout(config.hidden_dropout_prob)self.bilstm = nn.LSTM(input_size=config.lstm_embedding_size, # 1024hidden_size=config.hidden_size // 2, # 1024batch_first=True,num_layers=2,dropout=config.lstm_dropout_prob, # 0.5bidirectional=True)self.classifier = nn.Linear(config.hidden_size, config.num_labels)self.crf = CRF(config.num_labels, batch_first=True)self.init_weights()

5.2ǰ������

-

������

bert�����������ݡ�bert���ɲο�- ������ÿ��

token��Ӧ�ı��� - ����Ƕ�����

token�ı���

input_ids, input_token_starts = input_data # ѵ������, �Ѿ����䵽���ά�ȵ� outputs = self.bert(input_ids, # �� bert ����attention_mask=attention_mask,token_type_ids=token_type_ids,position_ids=position_ids,head_mask=head_mask,inputs_embeds=inputs_embeds) sequence_output = outputs[0] - ������ÿ��

-

��ԭ����

label��λ�ö�Ӧ�������ȡ����# ȥ��[CLS]��ǩ��λ�ã������label�����pre_label��ʾ origin_sequence_output = [layer[starts.nonzero().squeeze(1)] for layer, starts in zip(sequence_output, input_token_starts)] -

��

origin_sequence_output��䵽���# ��sequence_output��pred_labelά��padding����� padded_sequence_output = pad_sequence(origin_sequence_output, batch_first=True) -

��

padded_sequence_output����bilstm# dropout pred_label��һ����feature padded_sequence_output = self.dropout(padded_sequence_output) # ��סһ���� lstm_output, _ = self.bilstm(padded_sequence_output) -

���н�����б𣬷��ؽ��

logits��ÿ��λ�ö���label�Ĵ��(��bilstm���������ά�ȱ任)��С��(batch_size, max_len, num_labels)

Ҫע�⣬ֻ��label����Noneʱ������loss������ͻ�ֻ���ص÷֡���һ����train.py�У����Ʋ���label�������Ӷ�ֻ����÷�# �õ��б�ֵ logits = self.classifier(lstm_output) outputs = (logits,) if labels is not None:loss_mask = labels.gt(-1) # �����ڶ�labels��������ʱ��,��ʼ��ֵΪ -1����������ס����λ��loss = self.crf(logits, labels, loss_mask) * (-1)outputs = (loss,) + outputs # contain: (loss), scores return outputs��

(loss,) + outputs�Ľ��͡����Լ��������ǰ�loss���ӵ�ǰ�棬��ΪԪ��ĵ�һ��a = (1, )for i in range(10):a = (2, ) + aprint(a)>>(2, 2, 2, 2, 2, 2, 2, 2, 2, 2, 1)

6.ģ��ѵ��

6.1ѵ��һ��epoch

-

���ȿ���ѵ��ģʽ������ʵ������ʵ���ǿ���

dropout�����������������ɣ���ο� Pytorch model.train()_��������?�IJ���-CSDN����# set model to training mode model.train() # ����ѵ��ģʽ, Ϊ�˱ܿ�����ģʽ��Ӱ�� -

����

Dataloader���ʵ��train_loader���з���ѵ����һ��ѵ��һ��batch����train_epoch�������£�for idx, batch_samples in enumerate(tqdm(train_loader)): # tqdm �Ǽ���һ��������batch_data, batch_token_starts, batch_labels = batch_samplesbatch_masks = batch_data.gt(0) # token ���� 0 ��ʼ���ģ�# ǰ��,������������ lossloss = model((batch_data, batch_token_starts),token_type_ids=None, attention_mask=batch_masks, labels=batch_labels)[0] # ��һ���� loss��������һ����ᵽtrain_losses += loss.item()# �ݶȹ�0, ����model.zero_grad()loss.backward()# �ݶȲü�,�ݶȱ�ը�IJü���nn.utils.clip_grad_norm_(parameters=model.parameters(), max_norm=config.clip_grad)# ����optimizer.step()scheduler.step()- �����

mask����Ϊ���Ƕ�һ�仰������padding��self-attention���ע����λ�ã��������Dz����עpadding��λ�á�������Ǿ���ȡ������Щλ�ã�Ϊ0����Ȼ�����mask��

- �����

-

���ؽ��

train_loss = float(train_losses) / len(train_loader) logging.info("Epoch: {}, train loss: {}".format(epoch, train_loss))

6.2ѵ������epoch

-

����

epoch,����train_epoch���в������º�loss����for epoch in range(1, config.epoch_num + 1): # ���� epochtrain_epoch(train_loader, model, optimizer, scheduler, epoch)val_metrics = evaluate(dev_loader, model, mode='dev') # evaluate���Զ��庯��val_f1 = val_metrics['f1'] -

����

f1_score�ı仯�����Ƿ浱ǰģ�ͣ�������ֹͣѵ������������������������ֹͣѵ����

6.3evaluate����

�����mode = 'dev'�����õ�ǰ epoch ��ģ�Ͷ���֤������Ԥ�⣬�����metrics['loss'] = float(dev_losses) / len(dev_loader)��������Ԥ�� label ����ʵ label �����f1_score = metrics['f1'] ��

- Ҫע����ǣ����ǵ���

model����ǰ��ʱ���е�������label��Ȼ�����output[0]����loss - �е�û����

label�����صĽ����ÿ��λ�ö�����label�ĵ÷�

7.����ѵ������

-

����Ԥ����

# set the logger utils.set_logger(config.log_dir) logging.info("device: {}".format(config.device)) # �������ݣ������ı��ͱ�ǩ processor = Processor(config) processor.process() logging.info("--------Process Done!--------") -

����ѵ��������֤������ʹ�����湹����

Dataset�࣬�������ݼ���������Dataloader��# �������֤�� word_train, word_dev, label_train, label_dev = load_dev('train') # build dataset train_dataset = NERDataset(word_train, label_train, config) # ѵ������ dev_dataset = NERDataset(word_dev, label_dev, config) # ��֤���� logging.info("--------Dataset Build!--------") # get dataset size train_size = len(train_dataset) -

��

Dataset�����DataLoader�У��Խ��к����ķ�batchѵ��# build data_loader train_loader = DataLoader(train_dataset, batch_size=config.batch_size, # ѵ������ DataLoader shuffle=True, collate_fn=train_dataset.collate_fn) dev_loader = DataLoader(dev_dataset, batch_size=config.batch_size, # ��֤���� DataLoader shuffle=True, collate_fn=dev_dataset.collate_fn) logging.info("--------Get Dataloader!--------") -

��ģ��

device = config.device # ѡ���豸,����ѡ�� GPU model = BertNER.from_pretrained(config.bert_model, num_labels=len(config.label2id)) # ��ȡԤѵ��ģ�� model.to(device) # ��ģ���ƶ��� GPU �� -

�������ģ�͵IJ���ѡ���Ż�����ѡ���Ų��Ե�����

-

ģ��ѵ������������ģ��

-

ģ�Ͳ���

-

�����������ݿ��Բμ� ��BERT��NER��������PyTorch��������Roberta�� - ֪�� (zhihu.com)������ֻ�Դ������ݽ��н��⣬���о�ѵ���IJ���ѡ��

-

��Ϊֻ�ǽ�����룬���벢�DZ��˱�д�����︽��ԭ���ߴ����ַ hemingkx/CLUENER2020: A PyTorch implementation of a BiLSTM\BERT\Roberta(+CRF) model for Named Entity Recognition. (github.com)